1.【.NET 6+Loki+Grafana】实现轻量级日志可视化服务功能

2.通过transmittable-thread-local源码理解线程池线程本地变量传递的原理

3.收藏 Kafka监控组件大全

4.基于Prometheus + Grafana搭建IT监控报警最佳实践(2)

5.consulmanager部署和使用

6.部署Kafka监控

【.NET 6+Loki+Grafana】实现轻量级日志可视化服务功能

实现轻量级日志可视化服务功能

本文将通过使用Loki+Grafana来实现日志记录与可视化查询,简化日志管理与分析。首先,您需要准备的操作系统为WIN ,使用.NET环境为.NET 6,开发环境是妖刀斩源码VS 。

开始前,请下载Grafana安装包,确保选择最新企业版,当前最新版本为9.1.7。您可以从grafana.com/grafana/dow页面获取最新版本。接着,下载Loki环境,我选择的是2.6.0版本(最新版为2.6.1,但还未提供Windows安装版本)。您可根据需要从github.com/grafana/loki页面自行下载源码并编译为安装包。

安装完成后,输入blogs.com/weskynet/p/领取本地安装包,包括源码。

解压Loki至本地后,根据文档配置文件。注意配置文件中的retention_period应为小时的整数倍。更多Loki配置信息,请参考grafana.com/docs/loki/l页面。apache orc源码

启动Loki服务,推荐在控制台操作以确保稳定运行。启动命令为:xxx.exe --config.file=配置文件.yaml。若条件允许,您也可将Loki服务挂载到Windows中,方法参考另一篇文章,了解如何挂载Elasticsearch等至Windows服务。

创建测试案例,使用基于.NET6的webapi服务。在此服务中,引用serilog包,并在appsetrings配置文件中添加日志输出配置,分别输出至控制台与Loki,并配置日志标签用于查询和规则匹配。

在启动项内注册serilog日志服务,确保自动关联配置文件。在控制器中新增日志写入测试方法,注入日志服务,输出不同类型的日志。

运行程序后,通过Swagger接口测试日志写入,控制台将显示日志输出。在Grafana中,就学网源码通过数据源设置连接Loki,配置Loki部署地址(默认为本地),并测试连接成功。接下来,使用Explore菜单进行日志查询,预设查询区间,选择标签与标签值进行搜索,根据时间区间查询对应日志。同时,可以以Json形式查看日志,或进行关键字查询。

如果您需要配套的安装包和源码,可扫描下方二维码,或搜索公众号Dotnet Dancer,回复Loki获取所有内容。本文至此结束,希望对您的日志管理与分析工作有所帮助。

通过transmittable-thread-local源码理解线程池线程本地变量传递的原理

最近几周,我投入了大量的时间和精力,完成了UCloud服务和中间件迁移至阿里云的工作,因此没有空闲时间撰写文章。不过,回忆起很早之前对ThreadLocal源码的vip解析源码-分析,其中提到了ThreadLocal存在向预先创建的线程中传递变量的局限性。恰好,我的一位前同事,HSBC的技术大牛,提到了团队引入了transmittable-thread-local(TTL)来解决此问题。借此机会,我深入分析了TTL源码,本文将全面分析ThreadLocal和InheritableThreadLocal的局限性,并深入探讨TTL整套框架的实现。如有对线程池和ThreadLocal不熟悉的读者,建议先阅读相关前置文章,本篇文章行文较为干硬,字数接近5万字,希望读者耐心阅读。

在Java中,没有直接的API允许子线程获取父线程的实例。获取父线程实例通常需要通过静态本地方法Thread#currentThread()。同样,为了在子线程中传递共享变量,也常采用类似的方法。然而,这种方式会导致硬编码问题,限制了方法的oracle银行源码复用性和灵活性。为了解决这一问题,线程本地变量Thread Local应运而生,其基本原理是通过线程实例访问ThreadLocal.ThreadLocalMap来实现变量的存储与传递。

ThreadLocal与InheritableThreadLocal之间的区别主要在于控制ThreadLocal.ThreadLocalMap的创建时机和线程实例中对应的属性获取方式。通过分析源码,可以清楚地看到它们之间的联系与区别。对于不熟悉概念的读者,可以尝试通过自定义实现来理解其中的原理与关系。

ThreadLocal和InheritableThreadLocal的最大局限性在于无法为预先创建的线程实例传递变量。泛线程池Executor体系、TimerTask和ForkJoinPool等通常会预先创建线程,因此无法在这些场景中使用ThreadLocal和InheritableThreadLocal来传递变量。

TTL提供了更灵活的解决方案,它通过委托机制(代理模式)实现了变量的传递。委托可以基于Micrometer统计任务执行时间并上报至Prometheus,然后通过Grafana进行监控展示。此外,TTL通过字节码增强技术(使用ASM或Javassist等工具)实现了类加载时期替换Runnable、Callable等接口的实现,从而实现了无感知的增强功能。TTL还使用了模板方法模式来实现核心逻辑。

TTL框架的核心类TransmittableThreadLocal继承自InheritableThreadLocal,通过全局静态变量holder来管理所有TransmittableThreadLocal实例。holder实际上是一个InheritableThreadLocal,用于存储所有线程本地变量的映射,实现变量的全局共享。disableIgnoreNullValueSemantics属性的设置可以影响NULL值的处理方式,影响TTL实例的行为。

发射器Transmitter是TransmittableThreadLocal的一个公有静态类,提供传输TransmittableThreadLocal实例和注册当前线程变量至其他线程的功能。通过Transmitter的静态方法,可以实现捕获、重放和复原线程本地变量的功能。

TTL通过TtlRunnable类实现了任务的封装,确保在执行任务时能够捕获和传递线程本地变量。在任务执行前后,通过capture和restore方法捕获和重放变量,实现异步执行时上下文的传递。

启用TTL的Agent模块需要通过Java启动参数添加javaagent来激活字节码增强功能。TTL通过Instrumentation回调激发ClassFileTransformer,实现目标类的字节码增强,从而在执行任务时自动完成上下文的捕捉和传递。

TTL框架提供了一种高效、灵活的方式来解决线程池中线程复用时上下文传递的问题。通过委托机制和字节码增强技术,TTL实现了无入侵地提供线程本地变量传递功能。如果您在业务代码中遇到异步执行时上下文传递的问题,TTL库是一个值得考虑的解决方案。

收藏 Kafka监控组件大全

本文概述了用于监控Kafka系统的多种组件,包括Burrow、Telegraf、Grafana以及一些其他工具,如Kafka Manager、Kafka Eagle、Confluent Control Center和Kafka Offset Monitor。以下对这些工具进行了简要介绍。

Burrow是一个用于监控Kafka的组件,由Kafka社区的贡献者编写,主要关注于监控消费者端的情况。它使用Go语言编写,功能强大,但用户界面不提供,可通过GitHub获取二进制文件进行安装。

Telegraf是一个数据收集工具,与Burrow结合使用,用于收集Kafka监控数据,并将其存储到InfluxDB中,以便在Grafana中进行可视化展示。

Grafana是一个强大的数据可视化工具,允许用户创建仪表板,以直观地显示从Burrow收集的监控数据。通过配置Grafana,可以设置变量和图表,过滤集群并显示关键指标,如消费者滞后度、分区状态等。

Kafka Manager是一个受欢迎的监控组件,使用Scala编写,提供源码下载。它支持管理多个Kafka集群、副本分配、创建和管理Topic等功能,但编译过程较为复杂,且在处理大型集群时资源消耗大。

Kafka Eagle是一个由国人开发的监控工具,以其美观的界面和强大的数据展现能力受到推崇。它支持权限报警和多种报警方式,如钉钉、微信和邮件,还具备使用ksql查询数据的功能。

Confluent Control Center是一个功能齐全的Kafka监控框架,集成了多种监控和管理功能,但需购买Confluent企业版才能使用。官方文档提供了快速启动指南,但安装过程较为繁琐,需要引入特定的Kafka版本及其相关服务。

Kafka Monitor和Kafka Offset Monitor被认为是监控组件中的“炮灰”,具体信息不详。

综上所述,这些组件提供了从不同角度监控Kafka系统的能力,包括消费者监控、资源管理、性能分析和数据可视化等。选择合适的监控工具时,需要考虑功能需求、资源消耗和集成难度等因素。

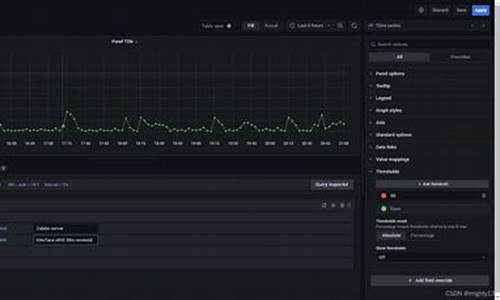

基于Prometheus + Grafana搭建IT监控报警最佳实践(2)

见字如面,大家好,我是小斐。延续前文,本文将深入探讨Prometheus和Grafana的监控体系。

首先,我们需要打开Prometheus和Grafana进行操作,访问地址分别为:...:/ 和 ...:/。

以node_exporter数据采集器为例,先确保其已安装于需要监控的主机。若要获取...主机的状态数据,需在该主机安装node_exporter采集器。

在prometheus.yml中添加需要抓取的目标源信息,具体操作为:在scrape_configs下添加job_name,指定静态目标,添加...:目标。

配置文件配置完成后,由于是静态的,需要重新加载配置文件,重启Prometheus以生效。

在targets中查看是否已抓取到目标,根据上图可见,...的主机节点数据已抓取到。在Prometheus中验证数据正确性,点击.dubbo.apache.org/zh-cn/overview/core-features/traffic/

流量管控商场示例:.dubbo.apache.org/zh-cn/overview/tasks/traffic-management/

作者:王宇轩,Apache Dubbo Committer