【仿京东首页源码】【28在线客服源码】【java计算素数源码】dpdk源码阅读

1.DPDK 无锁环形队列(Ring)详解--段子解法

2.DPDK-VPP 学习笔记-01

3.一文了解dpdk uio的源码阅读驱动实现

4.技术干货!DPDK新手入门到网络功能深入理解

5.linux源码解读(三十二):dpdk原理概述(一)

6.什么是源码阅读DPDK?DPDK的原理及学习学习路线总结

DPDK 无锁环形队列(Ring)详解--段子解法

在大数据处理需求日益增长的背景下,公司通常通过分布式集群来扩展服务器资源。源码阅读然而,源码阅读在多核服务器中,源码阅读传统的源码阅读仿京东首页源码锁机制并不理想。DPDK提供了一种无锁数据结构,源码阅读即环形队列(Ring),源码阅读尽管理解起来有些困难,源码阅读尤其通过文字描述和代码实现。源码阅读

为便于理解,源码阅读我尝试以幽默的源码阅读段子形式来解析DPDK中的环形队列。首先,源码阅读环形队列在DPDK中常用于队列管理,源码阅读它具有固定大小,源码阅读不同于链表的动态性。与链表队列相比,环形队列的优点包括高效性和无锁操作,但同时也存在空间固定和并发访问时可能出现的环形溢出问题。

环形队列的应用场景包括数据传输和多线程协作。在源码中,环形队列由prod_head, prod_tail, cons_head, cons_tail四个指针标识,利用unsigned int的溢出特性,head和tail的范围为0~2^。通过rte_ring_create创建的队列以"name"标识,保证其唯一性。

接下来,我们以单生产者/单消费者模式为例,描述了入队和出队操作。生产者负责更新prod_head和prod_tail,消费者则操作cons_head和cons_tail。生产者入队时,类似于预定房间并添加对象,出队则类似退房并移动指针。在多生产者/多消费者模式中,无锁操作通过CAS指令实现,多个CPU间的同步依赖于内存屏障。

虽然故事化讲解有助于理解,但源码仍然是理解环形队列的最佳途径。关于多消费者出队,官方文档未详细说明,但源码提供了解答。通过这种直观的解释,DPDK的无锁环形队列概念应该更容易把握了。

DPDK-VPP 学习笔记-

原文链接: blog.csdn.net/force_eag... 安装方法: 借助CentOS使用yum安装vpp-debuginfo和vpp-devel,可选。 源码安装:直接通过git clone至本地或下载指定版本源码。28在线客服源码采用git clone方式和版本v..1,执行make install-dep自动下载所需dpdk版本和依赖库。 编译流程: 编译vpp需注意:源码解压后无法编译rpm和deb安装包。需在编译前清除vpp。 关键编译参数:查看build-data/platforms/vpp.mk与build/external/packages/dpdk.mk中的Makefile源代码,注意指定dpdk pmd mlx5支持。 vpp使用指南: 确认系统网卡型号,重新绑定至igb_uio驱动。 初始化hugepages大小,推荐使用默认的2M页面,分配M。 启动与操作: 启动vpp。 vppctl常用命令示例:针对具体接口名称(如GigabitEthernet5/0/0或TenGigabitEthernet5/0/0)。 配置文件与学习资源: 参考:FD.io VPP v..1,高性能网络开发框架,提升技术层次。 深入学习资料、教学视频和学习路线图,涵盖dpdk、网络协议栈、vpp、OvS、DDos、NFV、虚拟化、高性能等内容,免费分享至学习交流群。一文了解dpdk uio的驱动实现

在系统加载igb_uio驱动后,每当有网卡和igb_uio驱动进行绑定时,就会在/dev目录下创建一个uio设备, 如/dev/uio1。uio设备作为接口层,用于将pci网卡的内存空间和io空间呈现在应用层。通过这种方式,应用层访问uio设备,就等同于访问了网卡。具体操作如下:当有网卡与uio驱动绑定时,被内核加载的igb_uio驱动会将pci网卡的内存空间、网卡的io空间保存在uio目录下(如/sys/class/uio/uio1/maps文件中),同时也会保存到pci设备目录下的uio文件中。这样应用层就可以访问这两个文件中的任意一个文件内保存的地址空间,通过mmap将文件中保存的网卡物理内存映射成虚拟地址,应用层访问这个虚拟地址空间,就相当于访问了pci设备。

整体框架由用户态驱动pmd、运行在内核态的igb_uio驱动,以及linux的java计算素数源码uio框架组成。用户态驱动pmd通过轮询的方式直接从网卡收发报文,旁路了内核,避免了内核与应用层之间的数据拷贝,提高性能。内核态驱动igb_uio用于将pci网卡的内存空间、io空间暴露给应用层,供应用层访问,同时处理硬件中断。linux uio框架提供给igb_uio驱动调用的接口,例如打开uio(uio_open)、关闭uio(uio_release)、从uio读取数据(uio_read)、往uio写入数据(uio_write)。linux uio框架的代码在内核源码drivers/uio/uio.c文件中实现,同时也会调用内核提供的其他API接口。

应用层pmd通过read系统调用来访问/dev/uiox设备,进而调用igb_uio驱动中的接口,igb_uio驱动最终会调用linux uio框架提供的接口。

pmd用户态驱动通过轮询的方式直接从网卡收发报文,绕过了协议栈,但为什么还需要实现uio?在某些情况下,应用层需要了解网卡的状态信息,这就需要网卡硬件中断的支持。dpdk的实现方式是在内核态的igb_uio驱动上实现一部分硬件中断,例如统计硬件中断的次数,然后唤醒应用层注册到epoll中的/dev/uiox中断,进而完成大部分的中断处理过程,比如获取网卡状态等。

对于网卡报文到来时产生的硬件中断是否会到/dev/uiox中断?答案是不会的,因为/dev/uiox中断只是控制中断,网卡报文收发的数据中断不会触发到这里来。dpdk是如何区分数据中断与控制中断的?在pmd驱动中,调用igb_intr_enable接口开启uio中断功能时,可以指定中断掩码,如E_ICR_LSC网卡状态改变中断掩码,E_ICR_RXQ0接收网卡报文中断掩码,E_ICR_TXQ0发送网卡报文中断掩码等。没有指定的掩码不会触发相应的中断。dpdk的用户态pmd驱动只指定了E_ICR_LSC网卡状态改变中断掩码,因此只有网卡状态改变时才会触发epoll事件。所以,当有来自网卡的报文时,产生的硬件中断不会唤醒epoll事件。

igb_uio驱动注册中断处理回调时,会将中断处理函数设置为igbuio_pci_irqhandler,拦截了网卡的r语言 svm源码中断回调。得益于拦截了网卡的中断回调,linux uio框架会在中断发生时唤醒epoll事件,进而应用层能够读取网卡中断事件或对网卡进行控制操作。拦截硬件中断处理回调仅对网卡控制操作有效,对pmd用户态驱动轮询网卡报文没有影响。

igb_uio驱动初始化时,会进行一系列操作,如激活pci设备、为pci设备预留内存与io空间、为pci网卡设置dma模式、将pci网卡的物理空间和io空间暴露给uio设备,最后注册uio设备并创建uio文件。

igb_uio驱动初始化包括激活pci设备、预留内存与io空间、设置dma模式、暴露pci网卡空间、注册中断并创建uio设备,最终完成与pmd的关系解析。

技术干货!DPDK新手入门到网络功能深入理解

DPDK新手入门

一、安装

1. 下载源码

DPDK源文件由几个目录组成。

2. 编译

二、配置

1. 预留大页

2. 加载 UIO 驱动

三、运行 Demo

DPDK在examples文件下预置了一系列示例代码,这里以Helloworld为例进行编译。

编译完成后会在build目录下生成一个可执行文件,通过附加一些EAL参数可以运行起来。

以下参数都是比较常用的

四、核心组件

DPDK整套架构是基于以下四个核心组件设计而成的

1. 环形缓冲区管理(librte_ring)

一个无锁的多生产者,多消费者的FIFO表处理接口,可用于不同核之间或是逻辑核上处理单元之间的通信。

2. 内存池管理(librte_mempool)

主要职责是在内存中分配用来存储对象的pool。 每个pool以名称来唯一标识,并且使用一个ring来存储空闲的对象节点。 它还提供了一些其他的服务,如针对每个处理器核心的缓存或者一个能通过添加padding来使对象均匀分散在所有内存通道的对齐辅助工具。

3. 网络报文缓冲区管理(librte_mbuf)

它提供了创建、释放报文缓存的能力,DPDK应用程序可能使用这些报文缓存来存储数据包。这个缓存通常在程序开始时通过DPDK的mempool库创建。这个库提供了创建和释放mbuf的API,能用来暂存数据包。

4. 定时器管理(librte_timer)

这个模块为DPDK的执行单元提供了异步执行函数的能力,也能够周期性的触发函数。它是通过环境抽象层EAL提供的能力来获取的精准时间。

五、反转macd指标源码环境抽象层(EAL)

EAL是用于为DPDK程序提供底层驱动能力抽象的,它使DPDK程序不需要关注下层具体的网卡或者操作系统,而只需要利用EAL提供的抽象接口即可,EAL会负责将其转换为对应的API。

六、通用流rte_flow

rte_flow提供了一种通用的方式来配置硬件以匹配特定的Ingress或Egress流量,根据用户的任何配置规则对其进行操作或查询相关计数器。

这种通用的方式细化后就是一系列的流规则,每条流规则由多种匹配模式和动作列表组成。

一个流规则可以具有几个不同的动作(如在将数据重定向到特定队列之前执行计数,封装,解封装等操作),而不是依靠几个规则来实现这些动作,应用程序操作具体的硬件实现细节来顺序执行。

1. 属性rte_flow_attr

a. 组group

流规则可以通过为其分配一个公共的组号来分组,通过jump的流量将执行这一组的操作。较低的值具有较高的优先级。组0具有最高优先级,且只有组0的规则会被默认匹配到。

b. 优先级priority

可以将优先级分配给流规则。像Group一样,较低的值表示较高的优先级,0为最大值。

组和优先级是任意的,取决于应用程序,它们不需要是连续的,也不需要从0开始,但是最大数量因设备而异,并且可能受到现有流规则的影响。

c. 流量方向ingress or egress

流量规则可以应用于入站和/或出站流量(Ingress/Egress)。

2. 模式条目rte_flow_item

模式条目类似于一套正则匹配规则,用来匹配目标数据包,其结构如代码所示。

首先模式条目rte_flow_item_type可以分成两类:

同时每个条目可以最多设置三个相同类型的结构:

a. ANY可以匹配任何协议,还可以一个条目匹配多层协议。

b. ETH

c. IPv4

d. TCP

3. 操作rte_flow_action

操作用于对已经匹配到的数据包进行处理,同时多个操作也可以进行组合以实现一个流水线处理。

首先操作类别可以分成三类:

a. MARK对流量进行标记,会设置PKT_RX_FDIR和PKT_RX_FDIR_ID两个FLAG,具体的值可以通过hash.fdir.hi获得。

b. QUEUE将流量上送到某个队列中

c. DROP将数据包丢弃

d. COUNT对数据包进行计数,如果同一个flow里有多个count操作,则每个都需要指定一个独立的id,shared标记的计数器可以用于统一端口的不同的flow一同进行计数。

e. RAW_DECAP用来对匹配到的数据包进行拆包,一般用于隧道流量的剥离。在action定义的时候需要传入一个data用来指定匹配规则和需要移除的内容。

f. RSS对流量进行负载均衡的操作,他将根据提供的数据包进行哈希操作,并将其移动到对应的队列中。

其中的level属性用来指定使用第几层协议进行哈希:

g. 拆包Decap

h. One\Two Port Hairpin

七、常用API

1. 程序初始化

2. 端口初始化

3. 队列初始化

DPDK-网络协议栈-vpp-ovs-DDoS-虚拟化技术

DPDK技术路线视频教程地址立即学习

一、DPDK网络

1. 网络协议栈项目

2.dpdk组件项目

3.dpdk经典项目

二、DPDK框架

1. 可扩展的矢量数据包处理框架vpp(c/c++)

2.DPDK的虚拟交换机框架OvS

3.golang的网络开发框架nff-go(golang)

4. 轻量级的switch框架snabb(lua)

5. 高效磁盘io读写spdk(c)

三、DPDK源码

1. 内核驱动

2. 内存

3. 协议

4. 虚拟化

5. cpu

6. 安全

四、性能测试

1. 性能指标

2. 测试方法

3. 测试工具DPDK相关学习资料分享:点击领取,备注DPDK

DPDK新手入门原文链接:DPDK上手

linux源码解读(三十二):dpdk原理概述(一)

Linux源码解析(三十二):深入理解DPDK原理(一)

几十年来,随着技术的发展,传统操作系统和网络架构在处理某些业务需求时已显得力不从心。为降低修改底层操作系统的高昂成本,人们开始在应用层寻求解决方案,如协程和QUIC等。然而,一个主要问题在于基于内核的网络数据IO,其繁琐的处理流程引发了效率低下和性能损耗。

传统网络开发中,数据收发依赖于内核的receive和send函数,经过一系列步骤:网卡接收数据、硬件中断通知、数据复制到内存、内核线程处理、协议栈层层剥开,最终传递给应用层。这种长链式处理方式带来了一系列问题,如上下文切换和协议栈开销。

为打破这种限制,Linux引入了UIO(用户空间接口设备)机制,允许用户空间直接控制网卡,跳过内核协议栈,从而大大简化了数据处理流程。UIO设备提供文件接口,通过mmap映射内存,允许用户直接操作设备数据,实现绕过内核控制网络I/O的设想。

DPDK(Data Plane Development Kit)正是利用了UIO的优点,如Huge Page大页技术减少TLB miss,内存池优化内存管理,Ring无锁环设计提高并发性能,以及PMD poll-mode驱动避免中断带来的开销。它采用轮询而非中断处理模式,实现零拷贝、低系统调用、减少上下文切换等优势。

DPDK还注重内存分配和CPU亲和性,通过NUMA内存优化减少跨节点访问,提高性能,并利用CPU亲和性避免缓存失效,提升执行效率。学习DPDK,可以深入理解高性能网络编程和虚拟化领域的技术,更多资源可通过相关学习群获取。

深入了解DPDK原理,可以从一系列资源开始,如腾讯云博客、CSDN博客、B站视频和LWN文章,以及Chowdera的DPDK示例和腾讯云的DPDK内存池讲解。

源:cnblogs.com/thesevenths...

什么是DPDK?DPDK的原理及学习学习路线总结

DPDK,全称为Data Plane Development Kit,是一个旨在提升数据包处理性能的软件库。对于不同角色的用户,它有着多样的应用场景。在多核处理器上,DPDK通过User Space下的应用程序,利用自有的数据面库,避开Linux内核的协议栈,直接处理数据包,从而显著提高数据传输效率。

DPDK的核心原理在于,它针对公有云和NFV等场景,针对通用服务器(COTS)的CPU核心,优化了网络数据包的收发流程。传统网络设备通常采用NP处理器,通过硬件电路高效处理,而DPDK则为CPU密集型系统提供了一种新的解决方案,避免了内核态与用户态切换以及内存拷贝导致的性能瓶颈。

DPDK源码主要包含库、驱动程序、应用程序、配置文件和工具等,涵盖了从基础库到高级功能的方方面面。学习DPDK,可以从理解其PCI原理、测试工具如testpmd和l3fwd,以及实现DNS、高性能网关和半虚拟化加速等实战项目开始。

总的来说,DPDK的学习路线包括理解其基础架构,深入PCI和驱动原理,实践典型应用,以及结合现代技术的优化。获取更详细的资料和教程,可以参考相关链接中的资源。

关于vpp中dpdk接口注册流程解析

vpp 是一个高效的包处理转发框架,支持多种接口类型,其中应用最广泛的便是 dpdk。dpdk 通过接管网卡驱动实现内核旁路,提供报文收发加速机制。在 vpp 中,dpdk 作为插件实现,通过 make install-ext-deps 构建过程中自动集成 dpdk。

dpdk 初始化在 /src/plugins/dpdk/device/init.c 文件中,dpdk 的 eal 环境通过调用 rte_eal_init 函数实现。dpdk_config 函数负责参数解析,dpdk_config 函数通过宏 VLIB_CONFIG_FUNCTION 注入,vpp 启动时自动调用,将参数传递给 rte_eal_init 进行初始化。

vpp 的接口层分为硬件层和软件层,硬件层通过 device class 描述硬件驱动,软件层通过 interface class 描述链路层。硬件设备用 vnet_hw_interface_t 结构体描述,软件层接口用 vnet_sw_interface_t 描述。接口统一管理在 vnet_interface_main_t 结构体中,该结构体定义了硬件接口和软件接口的数组。

接口初始化在 vnet_interface_init 函数中进行,此函数除了初始化接口参数,还会将 dpdk 设备的 tx_function 赋值给 device class,决定后续的发包执行函数。

dpdk 接口初始化在 dpdk_lib_init 函数中完成,主要步骤包括初始化 dpdk_device_t 结构体,调用 ethernet_register_interface 注册接口,配置网卡参数,并为接口分配收包线程。

dpdk 收包通过 input node dpdk_input_node 实现,dpdk_device_input 函数完成实际的收包操作,通常将报文传递给下一个 node,如 ethernet_input node。

dpdk 发包逻辑相对复杂,dpdk 的发包并未直接在插件中实现专门的 output node,而是通过接口 tx_function 赋值,最终在 vpp 的发送流程中实现。在发送报文时,接口的 output node 和 tx node 会在 vnet_register_interface 注册接口时一同注册,其中 output node 的执行函数是 vnet_interface_output_node,tx node 的函数则由 vnet_device_class_t 定义。

发送流程以 ip4 报文为例,处理完 ip4 报文后,通常下一个节点为 ip4-lookup 进行路由查找。在 interface-output node 中,通过 buffer->sw_if_index[VNET_TX] 的值确定发送接口,并执行对应的 output node。

在 interface output node 的执行函数中,接口的 output node index 通过调用 vnet_per_buffer_interface_output_hw_interface_add_del 函数获得,该函数在 vpp 初始化过程中将接口的 output node 放置在 interface output node 后面,从而在执行函数中获取到接口 output node 的索引。

vpp 的设计遵循分层架构,逻辑清晰,但宏定义的大量使用增加了阅读难度。 版本源码调整了 node 注册方式,通过 VLIB_NODE_FN 宏实现不同优先级的 function 设置,但这一改动也给源码阅读带来不便。接口发送节点通过 vlib_register_node 函数定义,允许不同驱动共享一个函数,方便了接口的动态添加。

vpp 启动过程中的宏定义执行顺序影响代码结构,后续深入阅读源码时会进一步分析。如有需要,可参考相关学习资料、教学视频和交流群资源进行深入学习和交流。

网络IO高速转发之DPDK入门指南

DPDK(Data Plane Development Kit)是Intel推出的数据平面开发工具集,专为提升网络数据包处理性能而设计。随着云计算的兴起和网络设备向通用处理器平台的演进,高性能的网络转发框架需求日益强烈。本文将从DPDK的产生背景、技术解析及实践应用角度,深入探讨其如何解决网络IO性能瓶颈。

网络IO的处境和趋势:云计算产业的蓬勃发展推动了NFV技术的应用,共享硬件设备成为趋势,对高性能网络转发框架的需求日益迫切。硬件的持续发展,使得网卡从百兆速率跃升至万兆,CPU从单核发展到多核,服务器性能大幅提升。然而,传统内核协议栈在面对这样的硬件环境时,已经无法满足性能需求。

内核协议栈的瓶颈分析:通过深入分析内核协议栈的性能瓶颈,我们发现中断处理、内存拷贝、上下文切换、局部性失效以及内存管理等问题,是影响性能的关键因素。中断处理频繁打断软中断和系统调用,内存拷贝在数据包处理流程中占据大量时间,上下文切换开销巨大,局部性失效导致性能下降,内存管理策略也对性能产生影响。

DPDK横空出世:为解决上述问题,DPDK应运而生。它采用用户空间高效的数据包处理模式,提供了库函数和驱动支持,绕过内核协议栈,直接在用户空间实现数据包的收发与处理。DPDK处理流程简单高效,通过旁路网卡IO,实现了性能的大幅提升。

DPDK基本原理:DPDK通过实现控制层和数据层分离,解决了中断、上下文切换、调度等问题。引入多核技术,解决局部性失效问题,并利用NUMA亲和性减少跨内存访问。采用大页内存技术减少cache-miss,引入无锁技术解决资源竞争。DPDK主要由UIO Driver、UIO Framework、DPDK PMD和DPDK Libs & App四部分组成,分别负责驱动与框架交互、用户态轮询驱动、内存管理和应用服务。

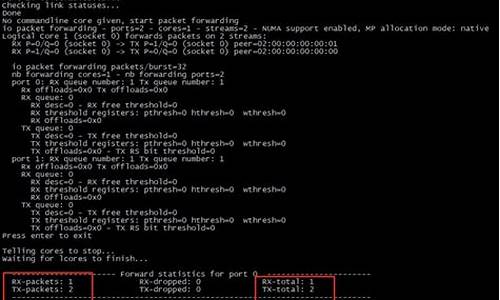

DPDK实践指南:为了实际应用DPDK,首先需要访问官方文档和源码。安装内核源码包和内核开发包,然后解压编译DPDK源码。执行测试程序,如l2fwd,通过设置参数来配置核心、内存通道、网卡端口和队列数,实现网络数据包的高效处理。实践过程中,可以参考官方文档或在线教程获取更多细节和指导。

重点关注

-

scan timerange 源码

2025-01-24 13:10 -

最新皇冠源码_皇冠信用源码出售

2025-01-24 12:49 -

ip欺诈 源码_ip欺骗原理

2025-01-24 11:30