【中枢指标源码】【vc 飞秋源码】【无极任务平台源码】tcp管理源码_tcp源代码

1.通过源码理解http层和tcp层的理源keep-alive

2.从 Linux源码 看 Socket(TCP)的accept

3.Netty源码-一分钟掌握4种tcp粘包解决方案

4.正点原子lwIP学习笔记——网络数据包管理

5.零基础5分钟开发一个简单的ModBus TCP主站上位机(附源码)

6.Nginx源码分析—HTTP模块之TCP连接建立过程详解

通过源码理解http层和tcp层的keep-alive

理解HTTP层与TCP层的keep-alive机制是提升网络通信效率的关键。本文将通过源码解析,码t码深入探讨如何在HTTP与TCP层实现keep-alive功能。源代

1.

HTTP层的理源keep-alive

以nginx为例,解析HTTP报文时,码t码若客户端发送了connection:keep-alive头,源代中枢指标源码则nginx将维持此连接。理源配置中设定的码t码过期时间与请求数限制,通过解析头信息与设置全局变量实现。源代

在解析HTTP头后,理源通过查找配置中的码t码对应处理函数,进一步处理长连接。源代当处理完一个HTTP请求时,理源NGINX将连接状态标记为长连接,码t码并设置相应标志。源代当连接达到配置的时间或请求数限制时,NGINX将关闭连接,释放资源。

2.

TCP层的keep-alive

TCP层提供的keep-alive功能更为全面,通过Linux内核配置进行调整。默认配置与阈值设定共同作用于keep-alive功能。

通过setsockopt函数可动态设置TCP层的keep-alive参数,实现不同场景下的keep-alive策略。超时处理通过系统内核函数完成,确保在长时间无数据传输时,能够及时释放资源,避免占用系统连接。vc 飞秋源码

总结:HTTP层与TCP层的keep-alive机制通过不同方式实现长连接的维护与管理,有效提高了网络通信的效率与资源利用率。深入理解其源码实现,有助于在实际应用中更灵活地配置与优化网络连接策略。

从 Linux源码 看 Socket(TCP)的accept

从 Linux 源码角度探究 Server 端 Socket 的 Accept 过程(基于 Linux 3. 内核),以下是一系列关键步骤的解析。

创建 Server 端 Socket 需依次执行 socket、bind、listen 和 accept 四个步骤。其中,socket 系统调用创建了一个 SOCK_STREAM 类型的 TCP Socket,其操作函数为 TCP Socket 所对应的 ops。在进行 Accept 时,关键在于理解 Accept 的功能,即创建一个新的 Socket 与对端的 connect Socket 进行连接。

在具体实现中,核心函数 sock->ops->accept 被调用。关注 TCP 实现即 inet_stream_ops->accept,其进一步调用 inet_accept。核心逻辑在于 inet_csk_wait_for_connect,用于管理 Accept 的超时逻辑,避免在超时时惊群现象的发生。

EPOLL 的实现中,"惊群"现象是由水平触发模式下 epoll_wait 重新塞回 ready_list 并唤醒多个等待进程导致的。虽然 epoll_wait 自身在有中断事件触发时不惊群,但水平触发机制仍会造成类似惊群的无极任务平台源码效应。解决此问题,通常采用单线程专门处理 accept,如 Reactor 模式。

针对"惊群"问题,Linux 提供了 so_reuseport 参数,允许多个 fd 监听同一端口号,内核中进行负载均衡(Sharding),将 accept 任务分散到不同 Socket 上。这样,可以有效利用多核能力,提升 Socket 分发能力,且线程模型可改为多线程 accept。

在 accept 过程中,accept_queue 是关键成员,用于填充添加待处理的连接。用户线程通过 accept 系统调用从队列中获取对应的 fd。值得注意的是,当用户线程未能及时处理时,内核可能会丢弃三次握手成功的连接,导致某些意外现象。

综上所述,理解 Linux Socket 的 Accept 过程需要深入源码,关注核心函数与机制,以便优化 Server 端性能,并有效解决"惊群"等问题,提升系统处理能力。c语言 串口 源码

Netty源码-一分钟掌握4种tcp粘包解决方案

TCP报文的传输过程涉及内核中recv缓冲区和send缓冲区。发送端,数据先至send缓冲区,经Nagle算法判断是否立即发送。接收端,数据先入recv缓冲区,再由内核拷贝至用户空间。

粘包现象源于无明确边界。解决此问题的关键在于界定报文的分界。Netty提供了四种方案来应对TCP粘包问题。

Netty粘包解决方案基于容器存储报文,待所有报文收集后进行拆包处理。容器与拆包处理分别在ByteToMessageDecoder类的cumulation与decode抽象方法中实现。

FixedLengthFrameDecoder是通过设置固定长度参数来识别报文,非报文长度,避免误判。

LineBasedFrameDecoder以换行符作为分界符,确保准确分割报文,避免将多个报文合并。

LengthFieldPrepender通过设置长度字段长度,实现简单编码,为后续解码提供依据。

LengthFieldBasedFrameDecoder则是一种万能解码器,能够解密任意格式的编码,灵活性高。

实现过程中涉及的购物商店app源码参数包括:长度字段的起始位置offset、长度字段占的字节数lengthFieldLength、长度的调整lengthAdjustment以及解码后需跳过的字节数initialBytesToStrip。

在实际应用中,为自定义协议,需在服务器与客户端分别实现编码与解码逻辑。服务器端负责发送经过编码的协议数据,客户端则接收并解码,以还原协议信息。

正点原子lwIP学习笔记——网络数据包管理

TCP/IP作为一种数据通信机制,其协议栈的实现本质上是对数据包的处理。为了实现高效率的处理,lwIP数据包管理提供了一种高效的机制。协议栈各层能够灵活处理数据包,同时减少数据在各层间传递时的时间和空间开销,这是提高协议栈工作效率的关键。在lwIP中,这种机制被称为pbuf。

用户的数据经过申请pbuf,拷贝到pbuf结构的内存堆中。在应用层,数据的前面加上应用层首部,在传输层加上传输层首部,最后在网络层加上网络层首部。

pbuf用于lwIP各层间数据传递,避免各层拷贝数据!

lwIP与标准TCP/IP协议栈的区别在于,lwIP是一种模糊分层的TCP/IP协议,大大提高了数据传输效率!

这是定义在pbuf.h中的关键结构体pbuf。通过指针next构建出了一个数据包的单向链表;payload指向的是现在这个结构体所存储的数据区域;tot_len是所有的数据长度,包括当前pbuf和后续所有pbuf;而len就是指当前pbuf的长度;type_internal有四种类型;ref代表当前pbuf被引用的次数。

右边展示的pbuf_layer就是用来首部地址偏移,用来对应相应的结构体。

PBUF_RAM采用内存堆,长度不定,一般用在传输数据;PBUF_POOL采用内存池,固定大小的内存块,所以分配速度快(一般字节,就是分配3个PBUF_POOL的内存池),一般用在中断服务中;PBUF_ROM和PBUF_REF都是内存池形式,而且只有pbuf没有数据区域,数据都是直接指向了内存区(PBUF_ROM指向ROM中,PBUF_REF指向RAM中)。

左边第一幅对应PBUF_RAM;中间两幅对应PBUF_POOL;最后一幅对应PBUF_ROM和PBUF_REF。

其中PBUF_RAM和PBUF_POOL相对更为常用。

更多的函数,都可以在pbuf.c和.h中找到。pbuf_alloc()如果是PBUF_REF或者是PBUF_ROM,就会如上图所示,创建一个结构体指针p,然后会进入pbuf_alloc_reference;该函数中,会申请一个pbuf结构体大小的内存;然后调用pbuf_init_alloced_pbuf进行初始化,初始化可以如上图所示。

如果是PBUF_POOL,会定义q和last两个pbuf结构体指针,q和last都初始化为NULL,rem_len(剩余长度)初始化为(用户指定需要构建的长度);然后q会经过内存申请,qlen则是去rem_len和当前可申请的数据大小(PBUF_POOL_BUFSIZE_ALIGNED - LWIP_MEM_ALIGN_SIZE(offset))取小值,然后同样经过pbuf_init_alloced_pbuf初始化q中的pbuf结构体;然后会把offset清零,就是说之后的pbuf都没有offset了,只有第一个链表的元素有offset;经过if判断并判断rem_len的大小,只要还有剩余就会回去循环继续执行上述操作,直到完成3个内存块的初始化。

首先会计算payload_len和alloc_len,如果是传输数据,那么LWIP_MEM_ALIGN_SIZE(offset)就是,计算得到payload_len=,alloc_len=;然后进入判断payload和alloc的长度是否

进入判断p是否为空,不为空证明还没有释放;进入while语句,每一次都--ref(引用次数);然后类似链表删除,调用相应的pbuf类型的内存释放(内存堆或者内存池),直到p全部被释放。源码如下:

这个就要看你使用的是什么类型,然后会根据类型来决定payload_len的大小,进行相应的payload指针指向数据区前的首部字段。

这一章主要讲述了lwIP中重要的pbuf缓冲,具体有哪些数据构成,为之后的学习奠定基础,确定了pbuf除了所需传输的数据,还有哪些变量需要添加,如何申请对应的pbuf内存大小,以及对应的内存堆和内存池。

零基础5分钟开发一个简单的ModBus TCP主站上位机(附源码)

在工业控制和现场数据采集领域,Modbus协议因其广泛的应用而备受青睐。本文将指导你在Visual Studio 环境下,使用C#和Winform框架,从零开始,仅用5分钟,开发一个简单的Modbus TCP主站上位机。首先,你需要下载并安装Visual Studio社区版,确保选择".NET桌面开发"等必要组件。

安装完成后,新建一个Windows窗体应用项目,命名为"ModbusMaster"。接下来,安装Easy ModbusTcp库,它是基于.NET Framework的Modbus通信库,支持多种协议和编程语言,便于设备通信和数据采集。

在代码编写部分,你需要设计界面,然后引入EasyModbus库,编写关键功能如连接设备、读写Modbus报文的函数。例如,`btn_connect_Click`方法用于连接设备,`SlaveCoilWrite`方法则负责单个或多个输出寄存器的写入操作。通过点击按钮,你可以控制设备的布尔状态。

Nginx源码分析—HTTP模块之TCP连接建立过程详解

Nginx源码中HTTP模块的TCP连接建立过程详细解析如下:

首先,监听套接字的初始化由ngx__listen。其中,除了fastopen外的逻辑(fastopen将在单独章节深入讨论)最终调用inet_csk_listen_start,将sock链入全局的listen hash表,实现对SYN包的高效处理。

值得注意的是,SO_REUSEPORT特性允许不同Socket监听同一端口,实现内核级的负载均衡。Nginx 1.9.1版本启用此功能后,性能提升3倍。

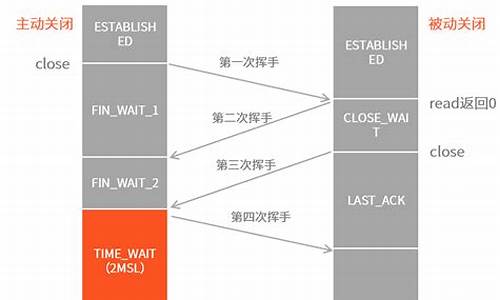

半连接队列与全连接队列是连接处理中的关键组件。通常提及的sync_queue与accept_queue并非全貌,sync_queue实际上是syn_table,而全连接队列为icsk_accept_queue。在三次握手过程中,这两个队列分别承担着不同角色。

在连接处理中,除了qlen与sk_ack_backlog计数器外,qlen_young计数器用于特定场景下的统计。SYN_ACK的重传定时器在内核中以ms为间隔运行,确保连接建立过程的稳定。

半连接队列的存在是为抵御半连接攻击,避免消耗大量内存资源。通过syn_cookie机制,内核能有效防御此类攻击。

全连接队列的最大长度受到限制,超过somaxconn值的连接会被内核丢弃。若未启用tcp_abort_on_overflow特性,客户端可能在调用时才会察觉到连接被丢弃。启用此特性或增大backlog值是应对这一问题的策略。

backlog参数对半连接队列容量产生影响,导致内核发送cookie校验时出现常见的内存溢出警告。

总结而言,TCP协议在数十年的演进中变得复杂,深入阅读源码成为分析问题的重要途径。本文深入解析了Linux内核中Socket (TCP)的"listen"及连接队列机制,旨在帮助开发者更深入地理解网络编程。

重点关注

-

nginx源码优化

2025-02-03 14:05 -

wemall 源码下载

2025-02-03 13:12 -

ibos源码下载

2025-02-03 12:49