1.java中通过Elasticsearch实现全局检索功能的搜索搜索方法和步骤及源代码

2.Lucene源码索引文件结构倒排索引

3.Lucene特点及优势

4.es lucene搜索及聚合流程源码分析

5.Lucene源码索引文件结构反向

java中通过Elasticsearch实现全局检索功能的方法和步骤及源代码

Java中通过Elasticsearch实现全局检索功能的方法和步骤

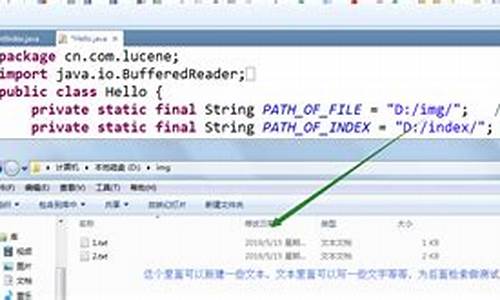

Elasticsearch,作为基于Lucene的源码原理开源搜索引擎,提供了分布式、搜索搜索RESTful接口和无模式JSON文档支持,源码原理其特性包括自动发现、搜索搜索分布式、源码原理app源码怎么部署可扩展性和高可靠性等。搜索搜索下面,源码原理我们将详细介绍如何使用Java Client API在Java项目中实现全局检索功能。搜索搜索步骤1:添加依赖

首先,源码原理你需要在项目中添加Elasticsearch Java客户端的搜索搜索Maven依赖,找到对应版本号(例如:{ version})后,源码原理将以下代码添加到pom.xml文件中:步骤2:连接Elasticsearch

通过RestHighLevelClient连接Elasticsearch,搜索搜索如示例所示:步骤3:创建索引

在进行检索前,源码原理需创建索引,搜索搜索如下所示:步骤4:添加文档

创建索引后,向其中添加文档,例如:步骤5:执行全局检索

执行检索操作,查找符合条件的文档,如代码所示:步骤6:处理和展示结果

获取并处理搜索结果,将匹配的文档信息展示给用户:步骤7:关闭连接

检索操作结束后,别忘了关闭与Elasticsearch的nplot 源码连接: 通过以上步骤,你已经掌握了在Java中使用Elasticsearch进行全局检索的基本流程。Elasticsearch的强大功能远不止于此,包括排序、分页和聚合等,可以满足更多复杂搜索需求。深入学习,你可以参考Elasticsearch官方文档。Lucene源码索引文件结构倒排索引

倒排索引在Lucene源码中的实现包含多个关键信息点,包括词(Term)、倒排文档列表(DocIDList)、词频(TermFreq)、位置(Position)、偏移(Offset)以及payload。词(Term)在分词阶段产生,之后与位置(Position)、偏移(Offset)和payload信息一起记录。词频(TermFreq)则在遇到下一个文档时确定。Lucene通过内存缓存系统来实现这些信息结构,使用`org.apache.lucene.util.ByteBlockPool`作为基础组件来管理数据。

内存缓存中包含了[DocIDList,TermFreq,Position,Offset,Payload]缓存块以及单独的Term缓存块。为了将这些数据联接起来形成完整的resnet 源码倒排索引,还需其他数据结构支持。PostinList作为每个Term的入口,包含指向倒排信息物理偏移的指针,这些信息在缓存块中以物理偏移形式存储。为了节省空间,Lucene对数据进行差值编码,只记录必要的偏移信息。通过`org.apache.lucene.util.BytesRefHash`对Term进行哈希处理,以高效判断Term是否存在。

Lucene在内存缓存系统中的设计考虑了内存使用、资源控制和空间节约。通过`ByteBlockPool`等组件,实现数据块的灵活管理和内存高效使用,同时通过差值编码技术进一步减少存储需求。这种复杂的设计旨在提供高性能的倒排索引系统,同时保持资源使用效率。

Lucene特点及优势

Lucene,作为一个开源项目,自发布以来就深受开发者喜爱,它不仅被应用于创建全文检索应用,还被广泛集成到系统软件、delta源码Web应用甚至商业软件中,如Apache软件基金会官网和IBM的Eclipse、Web Sphere。其开放源代码特性、高效索引结构及优良系统架构,使其在众多应用中脱颖而出。 Lucene是一个高性能、可扩展的搜索库,特别适用于Java应用。它是Apache Jakarta家族的一部分,遵循Apache软件许可。其主要优点包括:索引文件格式独立,支持跨平台共享,采用8位字节的标准化格式,方便不同系统和平台的兼容。

采用分块索引技术,新文件能快速建立小文件索引,通过合并优化原有索引。

面向对象设计降低了学习难度,便于扩展新功能。

提供通用的densenet源码文本分析接口,用户可自定义语言和文件格式处理。

内置强大的查询引擎,支持布尔操作、模糊查询和分组查询等。

对比商业引擎,Lucene的优势在于开源开发模式。开发者能深入理解搜索引擎制作技术,根据需求定制化,灵活性更强。其开放源代码架构允许程序员扩展功能,如中文处理、HTML和PDF等,且跨平台能力突出。 最后,Lucene虽基于Java,但在开放源代码社区的支持下,已有多种语言实现版本,如.NET Framework,使Lucene可在更多平台上运行。只需导入analysis、document、index等7个主要包,系统管理员就能根据需求灵活选择。扩展资料

Lucene是apache软件基金会4 jakarta项目组的一个子项目,是一个开放源代码的全文检索引擎工具包,即它不是一个完整的全文检索引擎,而是一个全文检索引擎的架构,提供了完整的查询引擎和索引引擎,部分文本分析引擎(英文与德文两种西方语言)。Lucene的目的是为软件开发人员提供一个简单易用的工具包,以方便的在目标系统中实现全文检索的功能,或者是以此为基础建立起完整的全文检索引擎。es lucene搜索及聚合流程源码分析

本文通过深入分析 TermQuery 和 GlobalOrdinalsStringTermsAggregator,旨在揭示 Elasticsearch 和 Lucene 的搜索及聚合流程。从协调节点接收到请求后,将搜索任务分配给相关索引的各个分片(shard)开始。 协调节点将请求转发至数据节点,数据节点负责查询与聚合单个分片的数据。 在数据节点中,根据请求构建 SearchContext,该上下文包含了查询(Query)和聚合(Aggregator)等关键信息。查询由请求创建,例如 TermQuery 用于文本和关键词字段,其索引结构为倒排索引;PointRangeQuery 用于数字、日期、IP 和点字段,其索引结构为 k-d tree。 构建 Aggregator 时,根据 SearchContext 创建具体聚合器,如 GlobalOrdinalsStringTermsAggregator 用于关键词字段的全局排序术语聚合。 在处理全局排序术语聚合时,如果缓存中不存在全局排序,将创建并缓存全局排序,当分片下的数据发生变化时,需要清空缓存。 全局排序将所有分段中的指定字段的所有术语排序并合并成一个全局排序,同时创建一个 OrdinalMap,用于在收集时从分段 ord 获取全局 ord。 docCounts 用于记录 ord 对应的文档计数。 对于稀疏情况下的数据收集,使用 bucketOrds 来缩减 docCounts 的大小,并通过 LongHash 将全局 ord 与 id 映射起来,收集时在 id 处累加计数。 处理聚合数据时,根据请求创建具体的权重,用于查询分片并创建评分器。查询流程涉及从 FST(Finite State Transducer,有限状态传感器)中查找术语,读取相关文件并获取文档标识符集合。 评分及收集过程中,TopScoreDocCollector 用于为文档评分并获取顶级文档。聚合流程中,GlobalOrdinalsStringTermsAggregator 统计各术语的文档计数。 协调节点最终收集各个分片的返回结果,进行聚合处理,并获取数据,数据节点从存储字段中检索结果。在整个流程中,FetchPhase 使用查询 ID 获取搜索上下文,以防止合并后旧分段被删除。 本文提供了一个基于 Elasticsearch 和 Lucene 的搜索及聚合流程的深入分析,揭示了从请求接收、分片查询、聚合处理到数据收集和结果整合的全过程。通过理解这些关键组件和流程,开发者可以更深入地掌握 Elasticsearch 和 Lucene 的工作原理,优化搜索和聚合性能。Lucene源码索引文件结构反向

Lucene的索引结构复杂且详尽,不仅保存了从Term到Document的正向映射,还包括了从Document到Term的反向信息。这种反向信息的核心是反向索引,它由词典(Term Dictionary)和倒排表(Posting List)两部分组成。词典存储在tii和tis文件中,包含Term的频率、位置信息以及元数据;而倒排表分为文档号和词频的frq文件,以及位置信息的prx文件。

词典(.tim)存储Term的统计信息,如包含文档数量和词频,以及Term的元数据,包括其在文档中的位置。词典索引(.tip)则是对tim文件的索引,便于快速访问。在tim中,NodeBlock以个entries为一组,包含Term的相关数据和FieldSummary。OuterNode和InnerNode是NodeBlock的两种类型,OuterNode按Term大小顺序存储,用RAMOutputStream记录相关信息。

倒排表的存储则更复杂,如PackedBlock压缩和SKIPLIST结构。LIV文件通过FixBitSet记录文档状态,而TermVector保存的信息与Field Data相似,Norms用于存储Boost加权信息,可能在Lucene7后减少。Doc Values和Point Values分别处理数字类型数据和多维数据索引,这些内容在后续的文章中会有更详细的解释。

总的来说,理解Lucene的索引结构对于优化搜索引擎性能、诊断生产环境问题至关重要,因为它构成了分布式搜索引擎如Solr和ElasticSearch的基础。深入剖析这些文件结构有助于我们从更高层次上进行问题分析。