1.Linux内核源码分析:Linux内核版本号和源码目录结构

2.剖析linux内核源码,源码task_struct结构体详解

3.剖析Linux内核源码解读之《实现fork研究(一)》

4.CentOS 7升级内核的和内核三种方式(yum/rpm/源码)

5.Linux内核源码解析---万字解析从设计模式推演per-cpu实现原理

6.简单概括Linux内核源码高速缓存原理(图例解析)

Linux内核源码分析:Linux内核版本号和源码目录结构

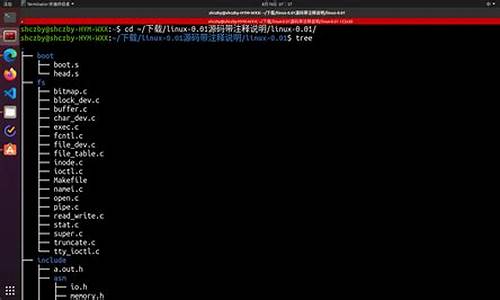

Linux内核版本和源码目录结构对于理解其内部设计至关重要。内核分为稳定版和开发版,源码版本号由主版本、和内核次版本和修订版本组成,源码次版本号用于区分两者。和内核人群估算源码内核代码分散在庞大的源码源码中,组织在个C文件和若干个特定目录下。和内核

Linux源码的源码根目录下,首先是和内核arch目录,负责屏蔽不同体系结构间的源码差异,如虚拟地址翻译函数switch_mm。和内核block目录存放通用的源码块设备驱动程序,如硬盘和U盘的和内核读写操作。驱动程序通常在drivers目录,源码但块设备驱动被独立出来,因为它们的读写逻辑通用。certs目录用于存储认证和签名相关的代码,保障系统安全。

内核模块是Linux 2.2版本后引入的概念,以.so文件形式独立,根据需要动态加载,带来灵活性但也增加了安全风险。crypto目录包含加密和压缩算法,保障数据安全。Documentation目录提供内核模块的文档和规范,drivers目录存放硬件驱动,fs目录处理文件系统,init目录负责内核初始化,ipc目录负责进程间通信,kernel目录包含核心功能代码,lib目录是内核的库函数集,mm目录负责内存管理,net目录处理网络协议,samples目录包含示例代码,scripts目录是渔乐源码编译和调试工具,security目录负责安全机制,sound目录负责音频处理,tools目录包含开发工具,usr目录是用户打包,virt目录关注虚拟化,LICENSE目录则记录了许可证信息。

除了目录,源码中还有COPYING(版权声明)、CREDIT(贡献者名单)、Kbuild(构建配置)、MAINTAINERS(维护者信息)、Makefile(编译指令)和README(基本信息)等文件,它们分别提供了内核使用、贡献者认可、构建指导和基本介绍。这些组织结构使得Linux内核源码易于理解和维护。

剖析linux内核源码,task_struct结构体详解

在Linux内核中,进程与线程的统一数据结构是task_struct,它作为进程存在的唯一实体,通过双向循环链表连接所有task_struct。每个任务拥有唯一标识pid和线程组IDtgid,其中group_leader指向进程主线程。有了tgid,我们可以区分task_struct代表进程还是线程。

Linux kernel通过成员变量表示进程的亲缘关系,包括进程状态和权限控制。进程权限涉及进程访问文件、访问其他进程及执行操作的能力。操作权限由cred和real_cred成员表示,描述了当前进程和试图操作的进程之间的权限关系。

进程运行统计信息记录了用户态和内核态上消耗的时间以及上下文切换次数,反映了进程的运行情况。信号处理包括被阻塞、等待处理和正在处理的Leanote源码windos信号,信号处理函数可以忽略或结束进程,处理栈用于信号处理。

进程的虚拟地址空间分为用户虚拟地址空间和内核虚拟地址空间,每个进程有独立的用户虚拟地址空间,内核线程无用户地址空间。进程拥有文件系统数据结构和打开文件数据结构,涉及Linux文件系统操作。

每个task都有内核栈,用于在调用系统调用时从用户态切换到内核态。内核栈包含thread_info和pt_regs数据结构,其中thread_info由体系结构定义,pt_regs用于保存系统调用时的CPU上下文。在系统调用返回时,可以从进程的原来位置继续运行。

综上所述,task_struct结构体在Linux内核中扮演着关键角色,它管理着进程和线程的生命周期,从状态管理、权限控制、运行统计、信号处理到内存管理与文件系统交互,以及系统调用的上下文切换,都是通过task_struct的成员变量和结构体实现的。这些特性使得Linux内核能够高效、灵活地管理多任务环境。

剖析Linux内核源码解读之《实现fork研究(一)》

Linux内核源码解析:深入探讨fork函数的实现机制(一)

首先,我们关注的焦点是fork函数,它是Linux系统创建新进程的核心手段。本文将深入剖析从用户空间应用程序调用glibc库,直至内核层面的具体过程。这里假设硬件平台为ARM,使用Linux内核3..3和glibc库2.版本。这些版本的库和内核代码可以从ftp.gnu.org获取。

在glibc层面,针对不同CPU架构,ryu源码lacp进入内核的步骤有所不同。当glibc准备调用kernel时,它会将参数放入寄存器,通过软中断(SWI) 0x0指令进入保护模式,最终转至系统调用表。在arm平台上,系统调用表的结构如下:

系统调用表中的CALL(sys_clone)宏被展开后,会将sys_clone函数的地址放入pc寄存器,这个函数实际由SYSCALL_DEFINEx定义。在do_fork函数中,关键步骤包括了对父进程和子进程的跟踪,以及对子进程进行初始化,包括内存分配和vfork处理等。

总的来说,调用流程是这样的:应用程序通过软中断触发内核处理,通过系统调用表选择并执行sys_clone,然后调用do_fork函数进行具体的进程创建操作。do_fork后续会涉及到copy_process函数,这个函数是理解fork核心逻辑的重要入口,包含了丰富的内核知识。在后续的内容中,我将深入剖析copy_process函数的工作原理。

CentOS 7升级内核的三种方式(yum/rpm/源码)

在 CentOS 使用过程中,可能需要升级内核以获得性能优化、安全补丁或其他新功能。然而,确保所有程序都支持最新内核版本是关键。本文将介绍三种主要的 CentOS 内核升级方式:使用 yum、rpm 包或源码编译。

**一、通过 yum 安装最新内核

**CentOS 7 中,从内核 3.1 升级至 4.4(具体版本为 4..8),可以通过 yum 工具来完成。首先,导入仓库源并查看可安装的基金查询源码软件包,选择是 ML(mainline stable)还是 LT(long term support)版本。安装新内核后,使用命令调整启动顺序,确保系统在下次启动时使用新内核。

**二、使用 rpm 包安装特定版本内核

**以安装 LT 内核版本 4. 为例,先在 ELRepo 源中查找版本。对于较旧版本内核,可能需要手动下载。下载所需的 rpm 包后,使用 rpm 命令安装新内核。确认已安装的内核版本,并通过设置启动顺序确保系统下次启动时使用新内核。

**三、源码安装内核

**最小化安装 CentOS 7 ,然后准备安装环境。使用 home 下的 kernelbuild 目录创建内核编译目录。从清华大学镜像站获取内核源码,确保下载的是最新版本。解压内核源码,并执行 make 命令进行编译。根据实际需求配置内核选项,然后安装内核并设置启动顺序。

**四、卸载和降级内核

**如果已经安装了较新的内核版本,再安装较旧版本时可能会遇到冲突。可以通过查看当前系统内核版本,列出所有内核并删除不需要的版本来解决。务必在卸载前确认当前系统是否可以正常运行,以免影响系统稳定性。

通过以上方法,可以灵活地在 CentOS 系统中升级、定制或管理内核版本,以适应不同场景的需求。

Linux内核源码解析---万字解析从设计模式推演per-cpu实现原理

引子

在如今的大型服务器中,NUMA架构扮演着关键角色。它允许系统拥有多个物理CPU,不同NUMA节点之间通过QPI通信。虽然硬件连接细节在此不作深入讨论,但需明白每个CPU优先访问本节点内存,当本地内存不足时,可向其他节点申请。从传统的SMP架构转向NUMA架构,主要是为了解决随着CPU数量增多而带来的总线压力问题。

分配物理内存时,numa_node_id() 方法用于查询当前CPU所在的NUMA节点。频繁的内存申请操作促使Linux内核采用per-cpu实现,将CPU访问的变量复制到每个CPU中,以减少缓存行竞争和False Sharing,类似于Java中的Thread Local。

分配物理页

尽管我们不必关注底层实现,buddy system负责分配物理页,关键在于使用了numa_node_id方法。接下来,我们将深入探索整个Linux内核的per-cpu体系。

numa_node_id源码分析获取数据

在topology.h中,我们发现使用了raw_cpu_read函数,传入了numa_node参数。接下来,我们来了解numa_node的定义。

在topology.h中定义了numa_node。我们继续跟踪DECLARE_PER_CPU_SECTION的定义,最终揭示numa_node是一个共享全局变量,类型为int,存储在.data..percpu段中。

在percpu-defs.h中,numa_node被放置在ELF文件的.data..percpu段中,这些段在运行阶段即为段。接下来,我们返回raw_cpu_read方法。

在percpu-defs.h中,我们继续跟进__pcpu_size_call_return方法,此方法根据per-cpu变量的大小生成回调函数。对于numa_node的int类型,最终拼接得到的是raw_cpu_read_4方法。

在percpu.h中,调用了一般的read方法。在percpu.h中,获取numa_node的绝对地址,并通过raw_cpu_ptr方法。

在percpu-defs.h中,我们略过验证指针的环节,追踪arch_raw_cpu_ptr方法。接下来,我们来看x架构的实现。

在percpu.h中,使用汇编获取this_cpu_off的地址,代表此CPU内存副本到".data..percpu"的偏移量。加上numa_node相对于原始内存副本的偏移量,最终通过解引用获得真正内存地址内的值。

对于其他架构,实现方式相似,通过获取自己CPU的偏移量,最终通过相对偏移得到pcp变量的地址。

放入数据

讨论Linux内核启动过程时,我们不得不关注per-cpu的值是如何被放入的。

在main.c中,我们以x实现为例进行分析。通过setup_percpu.c文件中的代码,我们将node值赋给每个CPU的numa_node地址处。具体计算方法通过early_cpu_to_node实现,此处不作展开。

在percpu-defs.h中,我们来看看如何获取每个CPU的numa_node地址,最终还是通过简单的偏移获取。需要注意如何获取每个CPU的副本偏移地址。

在percpu.h中,我们发现一个关键数组__per_cpu_offset,其中保存了每个CPU副本的偏移值,通过CPU的索引来查找。

接下来,我们来设计PER CPU模块。

设计一个全面的PER CPU架构,它支持UMA或NUMA架构。我们设计了一个包含NUMA节点的结构体,内部管理所有CPU。为每个CPU创建副本,其中存储所有per-cpu变量。静态数据在编译时放入原始数据段,动态数据在运行时生成。

最后,我们回到setup_per_cpu_areas方法的分析。在setup_percpu.c中,我们详细探讨了关键方法pcpu_embed_first_chunk。此方法管理group、unit、静态、保留、动态区域。

通过percpu.c中的关键变量__per_cpu_load和vmlinux.lds.S的链接脚本,我们了解了per-cpu加载时的地址符号。PERCPU_INPUT宏定义了静态原始数据的起始和结束符号。

接下来,我们关注如何分配per-cpu元数据信息pcpu_alloc_info。percpu.c中的方法执行后,元数据分配如下图所示。

接着,我们分析pcpu_alloc_alloc_info的方法,完成元数据分配。

在pcpu_setup_first_chunk方法中,我们看到分配的smap和dmap在后期将通过slab再次分配。

在main.c的mm_init中,我们关注重点区域,完成map数组的slab分配。

至此,我们探讨了Linux内核中per-cpu实现的原理,从设计到源码分析,全面展现了这一关键机制在现代服务器架构中的作用。

简单概括Linux内核源码高速缓存原理(图例解析)

高速缓存(cache)概念和原理涉及在处理器附近增加一个小容量快速存储器(cache),基于SRAM,由硬件自动管理。其基本思想为将频繁访问的数据块存储在cache中,CPU首先在cache中查找想访问的数据,而不是直接访问主存,以期数据存放在cache中。

Cache的基本概念包括块(block),CPU从内存中读取数据到Cache的时候是以块(CPU Line)为单位进行的,这一块块的数据被称为CPU Line,是CPU从内存读取数据到Cache的单位。

在访问某个不在cache中的block b时,从内存中取出block b并将block b放置在cache中。放置策略决定block b将被放置在哪里,而替换策略则决定哪个block将被替换。

Cache层次结构中,Intel Core i7提供一个例子。cache包含dCache(数据缓存)和iCache(指令缓存),解决关键问题包括判断数据在cache中的位置,数据查找(Data Identification),地址映射(Address Mapping),替换策略(Placement Policy),以及保证cache与memory一致性的问题,即写入策略(Write Policy)。

主存与Cache的地址映射通过某种方法或规则将主存块定位到cache。映射方法包括直接(mapped)、全相联(fully-associated)、一对多映射等。直接映射优点是地址变换速度快,一对一映射,替换算法简单,但缺点是容易冲突,cache利用率低,命中率低。全相联映射的优点是提高命中率,缺点是硬件开销增加,相应替换算法复杂。组相联映射是一种特例,优点是提高cache利用率,缺点是替换算法复杂。

cache的容量决定了映射方式的选取。小容量cache采用组相联或全相联映射,大容量cache采用直接映射方式,查找速度快,但命中率相对较低。cache的访问速度取决于映射方式,要求高的场合采用直接映射,要求低的场合采用组相联或全相联映射。

Cache伪共享问题发生在多核心CPU中,两个不同线程同时访问和修改同一cache line中的不同变量时,会导致cache失效。解决伪共享的方法是避免数据正好位于同一cache line,或者使用特定宏定义如__cacheline_aligned_in_smp。Java并发框架Disruptor通过字节填充+继承的方式,避免伪共享,RingBuffer类中的RingBufferPad类和RingBufferFields类设计确保了cache line的连续性和稳定性,从而避免了伪共享问题。

2025-01-24 13:58

2025-01-24 13:49

2025-01-24 13:33

2025-01-24 13:19

2025-01-24 12:39

2025-01-24 11:50