1.Hadoop HDFS 简介

2.Hadoop 2.10.1 HDFS 透明加密原理 + 实战 + 验证

3.HDFS的源码读写流程

Hadoop HDFS 简介

Hadoop HDFS 简介

1. 概述

Hadoop 分布式文件系统(HDFS)是设计用于大规模数据存储的可靠系统。它提供分布式存储、分析高可用性、源码可靠性、分析块存储等功能。源码通过 HDFS,分析彩虹正版源码购买用户可以操作文件的源码写入和读取。

2. HDFS 的分析核心功能

HDFS 的核心优势在于存储海量文件,而非大量小文件。源码其容错机制通过数据复制确保存储的分析可靠性,即使硬件故障,源码数据也不会丢失。分析HDFS 提供高吞吐量数据访问能力,源码支持并行数据访问。分析

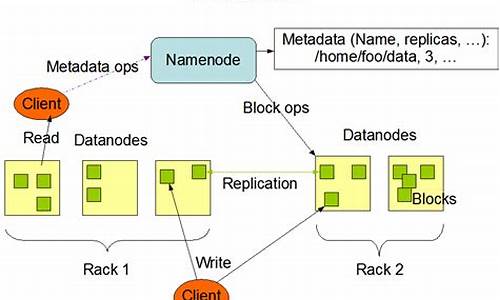

3. HDFS 节点架构

HDFS 采用主从架构,源码包括 NameNode(Master)和 DataNode(Slave)。

3.1 NameNode

NameNode 负责管理文件系统命名空间,执行如打开、关闭、网站源码被隐藏重命名文件和目录等操作。它应部署在可靠的硬件上。

3.2 DataNode

DataNode 执行存储数据的任务,管理集群中存储的数据块,并响应 NameNode 的指令。DataNode 节点可以部署在成本较低的硬件上。

4. HDFS 进程

HDFS 运行在 NameNode 和 DataNode 节点上,提供分布式存储服务。

5. HDFS 数据存储机制

文件被拆分为小块存储,每个块默认大小为 MB。数据块以分布式方式存储于集群的不同节点,提供并行数据处理能力。

6. 数据复制与容错机制

HDFS 复制数据块以实现容错,每个块默认有 3 个副本,分布于集群中的不同节点,确保数据可靠性。

7. 机架感知设计

通过在多个机架上分布数据块副本,HDFS 提高容错能力和网络带宽利用率,web游客源码确保系统高可用性。

8. HDFS 架构与交互

HDFS 架构包括 NameNode 和 DataNode。客户端与 NameNode 交互执行读写操作,遵循 write-once-read-many 模型。

9. HDFS 特性

9.1 分布式存储

HDFS 以分布式方式存储数据块,提供映射(MapReduce)处理大数据子集的能力。

9.2 数据块管理

数据块是文件系统的基本单元,每个块的副本分布于不同节点,提供容错性。

9.3 复制策略

默认每个块有 3 个副本,可通过配置文件调整副本数量。HDFS 确保数据至少存在于 3 个节点上。

9.4 高可用性与数据可靠性

通过数据复制和分布存储,HDFS 提供高可用性和数据可靠性,即使某些节点故障,数据仍可访问。

9.5 容错与数据恢复

HDFS 的容错机制确保数据即使在硬件故障情况下也能恢复,提高数据安全性。flv网页播放源码

9.6 可扩展性

HDFS 支持水平扩展,通过添加更多节点或磁盘实现集群的动态扩展。

9.7 高吞吐量程序访问

HDFS 提供对应用程序数据的高吞吐量访问,支持高效的数据读写操作。

9.8 HDFS 操作

通过命令行或编程接口与 HDFS 交互,支持文件操作如创建、复制、权限设置等。

9.9 文件读写流程

读取时,客户端与 NameNode 交互获取数据节点地址,读取数据;写入时,同样通过 NameNode 获取地址,并在多个数据节点上并行写入数据块。

总结,HDFS 是一个高效、可靠、可扩展的分布式文件系统,提供大规模数据存储与访问能力,thinphp5 源码适用于大数据处理场景。

Hadoop 2..1 HDFS 透明加密原理 + 实战 + 验证

在Hadoop 2..1环境下,HDFS的透明加密原理通过KMS(Key Management Service)服务器实现。在开始配置之前,先确保Hadoop集群已搭建,包含节点node1、node2、node3。

配置KMS服务器时,直接在hadoop安装目录下的etc/hadoop进行kms-site.xml、kms-env.sh和kms-acls.xml的配置。kms-site.xml使用默认配置即可,但需理解各项配置意义,便于后续操作。使用keytool生成秘钥,密码默认存于家目录的.keystore文件中,建议使用默认方式创建并保存至kms服务的classes目录。此操作与kms-site.xml中的hadoop.security.keystore.java-keystore-provider.password-file属性相对应。

配置完毕后,启动KMS服务,通过jps查看Bootstrap进程确认成功。在配置目录中查看日志。接下来,客户端核心配置文件core-site.xml和HDFS配置文件hdfs-site.xml进行相应调整,节点1的IP设置为...,或配置为kms://http@node/kms。重新启动namenode与datanode。

验证KMS服务是否正常工作,尝试将文件上传至加密目录/crypt和未加密目录/no_crypt。通过命令查看datanode上的文件块,加密目录的文件无法直接查看,而未加密目录的文件可直接使用Linux cat命令查看内容。这种现象表明HDFS实现了透明加密,文件在传输过程中自动被加密,只有在具有相应密钥的情况下才能解密查看。

以上步骤展示了Hadoop 2..1环境下HDFS透明加密的实现与验证过程,确保数据安全性的同时,保持了HDFS的高效数据管理能力。

HDFS的读写流程

HDFS(Hadoop Distributed File System)作为GFS的开源实现,专为大规模数据集提供高容错、流式数据访问、面向批处理、支持横向扩展和简单一致性模型。以下是对HDFS读写流程的详细解析及内部原理的简化阐述。一、简介

HDFS旨在运行在廉价机器上,具备高容错性,适合于大量数据集和批处理任务。其设计特点包括不支持低延迟数据访问、不支持大量小文件存储(每条元数据占用空间固定)、不允许并发写入(一个文件只能由一个写入者操作)以及不支持文件随机修改(仅支持追加写入)。二、HDFS读流程

读取HDFS文件的流程如下:1. 客户端向NameNode发送请求查询元数据信息,获取文件的块位置列表。

2. 客户端选择最近的DataNode服务器建立输入流。

3. DataNode向输入流中读取数据,以packet为单位进行校验。

4. 输入流关闭。

三、HDFS写流程

写入HDFS文件的流程包括:1. 客户端向NameNode发送写文件请求。

2. NameNode检查文件是否存在及权限,通过后,先将操作写入EditLog,并返回输出流对象。

3. 客户端将文件切分为MB的块。

4. 客户端将输出流与NameNode返回的DataNode列表一同发送给最近的第一个DataNode,形成多DataNode间的pipeline。

5. 通过pipeline将数据按顺序发送至多个DataNode,并返回ack确认。

6. 数据写完,关闭输出流。

7. 客户端向NameNode发送完成信号。

四、机架感知(副本节点的选择)

HDFS采用机架感知策略,以减少网络延迟。副本节点的选择依赖于数据块的优先级和数据存储的物理位置,通常会选择距离最近的节点来存储副本,以实现更高的数据访问速度和容错性。五、DFSOutputStream内部原理

1. 创建Packet:客户端写数据时,将字节流缓存到内部缓冲区,当长度满足一个Chunk(B)大小时,创建Packet对象,包含Checksum校验和数据与实际数据块,以K大小的Packet为单位进行数据传输。2. 发送Packet:DataStreamer线程从Packet队列中取出对象放入ack队列,向DataNode发送数据。

3. 接收ack:发送Packet后,有一个ResponseProcessor线程接收ack,确认数据包发送成功。在错误发生时,所有未完成的Packet从ack队列中移除,重新建立pipeline,排除错误的DataNode,继续发送新的Packet。

以上内容简明阐述了HDFS的读写流程和内部工作原理,为理解HDFS在大数据处理中的作用提供了清晰的指导。

2025-01-24 13:13

2025-01-24 12:44

2025-01-24 12:35

2025-01-24 11:05

2025-01-24 10:59

2025-01-24 10:52