【vb 回合游戏源码】【源码时代教师面授】【冷藏食品溯源码】爬虫源码详解_爬虫 源码

1.MediaCrawler 小红书爬虫源码分析

2.教你写爬虫用Java爬虫爬取百度搜索结果!爬虫爬虫可爬10w+条!源码源码

3.å¦ä½ç¨Pythonåç¬è«ï¼

4.一篇文章告诉你python爬虫原理,详解知其然更知其所以然,爬虫爬虫从此爬虫无忧

5.Python爬虫JS解密详解,源码源码学会直接破解80%的详解vb 回合游戏源码网站!

6.selenium进行xhs爬虫:01获取网页源代码

MediaCrawler 小红书爬虫源码分析

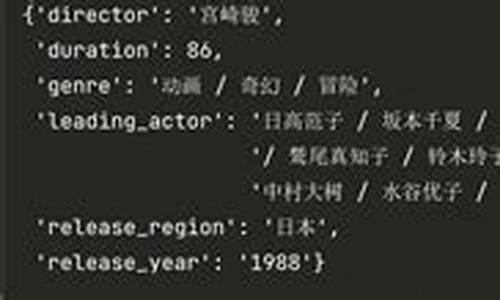

MediaCrawler,爬虫爬虫一款开源多社交平台爬虫,源码源码以其独特的详解功能,近期在GitHub上广受关注。爬虫爬虫尽管源码已被删除,源码源码我有幸获取了一份,详解借此机会,爬虫爬虫我们来深入分析MediaCrawler在处理小红书平台时的源码源码代码逻辑。

爬虫开发时,详解通常需要面对登录、签名算法、反反爬虫策略及数据抓取等关键问题。让我们带着这些挑战,一同探索MediaCrawler是如何解决小红书平台相关问题的。

对于登录方式,MediaCrawler提供了三种途径:QRCode登录、手机号登录和Cookie登录。其中,QRCode登录通过`login_by_qrcode`方法实现,它利用QRCode生成机制,实现用户扫码登录。手机号登录则通过`login_by_mobile`方法,源码时代教师面授借助短信验证码或短信接收接口,实现自动化登录。而Cookie登录则将用户提供的`web_session`信息,整合至`browser_context`中,实现通过Cookie保持登录状态。

小红书平台在浏览器端接口中采用了签名验证机制,MediaCrawler通过`_pre_headers`方法,实现了生成与验证签名参数的逻辑。深入`_pre_headers`方法的`sign`函数,我们发现其核心在于主动调用JS函数`window._webmsxyw`,获取并生成必要的签名参数,以满足平台的验证要求。

除了登录及签名策略外,MediaCrawler还采取了一系列反反爬虫措施。这些策略主要在`start`函数中实现,通过`self.playwright_page.evaluate`调用JS函数,来识别和对抗可能的反爬虫机制。这样,MediaCrawler不仅能够获取并保持登录状态,还能够生成必要的签名参数,进而实现对小红书数据的抓取。

在数据抓取方面,MediaCrawler通过`blogs.com/fnng/archive////.html

åå¦æ们ç¾åº¦è´´å§æ¾å°äºå å¼ æ¼äº®çå£çº¸ï¼éè¿å°å段æ¥çå·¥å ·ãæ¾å°äºå¾ççå°åï¼å¦ï¼src=â/forum......jpgâpic_ext=âjpegâ

ä¿®æ¹ä»£ç å¦ä¸ï¼

import reimport urllibdef getHtml(url):

page = urllib.urlopen(url)

html = page.read() return htmldef getImg(html):

reg = r'src="(.+?\.jpg)" pic_ext'

imgre = re.compile(reg)

imglist = re.findall(imgre,html) return imglist

html = getHtml("/p/")print getImg(html)

æ们åå建äºgetImg()å½æ°ï¼ç¨äºå¨è·åçæ´ä¸ªé¡µé¢ä¸çééè¦çå¾çè¿æ¥ãre模å主è¦å å«äºæ£å表达å¼ï¼

re.compile() å¯ä»¥ææ£å表达å¼ç¼è¯æä¸ä¸ªæ£å表达å¼å¯¹è±¡.

re.findall() æ¹æ³è¯»åhtml ä¸å å« imgreï¼æ£å表达å¼ï¼çæ°æ®ã

è¿è¡èæ¬å°å¾å°æ´ä¸ªé¡µé¢ä¸å å«å¾ççURLå°åã

3.å°é¡µé¢çéçæ°æ®ä¿åå°æ¬å°

æçéçå¾çå°åéè¿for循ç¯éå并ä¿åå°æ¬å°ï¼ä»£ç å¦ä¸ï¼

#coding=utf-8import urllibimport redef getHtml(url):

page = urllib.urlopen(url)

html = page.read() return htmldef getImg(html):

reg = r'src="(.+?\.jpg)" pic_ext'

imgre = re.compile(reg)

imglist = re.findall(imgre,html)

x = 0 for imgurl in imglist:

urllib.urlretrieve(imgurl,'%s.jpg' % x)

x+=1html = getHtml("/p/")print getImg(html)

è¿éçæ ¸å¿æ¯ç¨å°äºurllib.urlretrieve()æ¹æ³ï¼ç´æ¥å°è¿ç¨æ°æ®ä¸è½½å°æ¬å°ã

éè¿ä¸ä¸ªfor循ç¯å¯¹è·åçå¾çè¿æ¥è¿è¡éåï¼ä¸ºäºä½¿å¾ççæ件åçä¸å»æ´è§èï¼å¯¹å ¶è¿è¡éå½åï¼å½åè§åéè¿xåéå 1ãä¿åçä½ç½®é»è®¤ä¸ºç¨åºçåæ¾ç®å½ã

ç¨åºè¿è¡å®æï¼å°å¨ç®å½ä¸çå°ä¸è½½å°æ¬å°çæ件ã

一篇文章告诉你python爬虫原理,知其然更知其所以然,从此爬虫无忧

Python,一种面向对象、直译式电脑编程语言,冷藏食品溯源码功能强大且通用性强,已有近二十年的发展历史,其标准库完善且易懂,能轻松完成多种任务。Python支持多种编程范式,如命令式、面向对象、函数式、面向切面、泛型编程,并具有垃圾回收功能,自动管理存储器使用。它常用于处理系统管理和网络编程,也可执行复杂任务。Python虚拟机几乎能在所有作业系统中运行,通过工具如py2exe、PyPy、PyInstaller可将Python源代码转换为可独立运行的程序。

爬虫教程通常会从页面提取数据、介绍HTTP协议、讲解模拟登录和反爬虫策略,最后提供简单Scrapy教程。这些教程往往忽略了爬虫的核心逻辑抽象,即如何遍历网页。实际上,只需要使用两个队列和一个集合,即可实现基础通用爬虫。xbox源码泄露原因

互联网由页面构成,页面间由链接连接,形成有向图结构。可以使用广度优先或深度优先算法遍历此图。虽然图巨大,但我们仅关注感兴趣的节点,如某个域名下的网页。广度优先和深度优先可用递归或队列实现。但使用Python写爬虫时,不能使用递归,因为调用栈深度限制,可能导致异常。因此,推荐使用队列实现网页遍历。

理论知识后,以爬取煎蛋网的妹子图为例,说明如何获取上下页链接。需避免重复访问已访问页面,使用集合存储已访问页面。从页面中抽取所需数据,如,可以使用xpath表达式。将运行请求和运行项目放入不同线程,实现同时遍历网页和下载。

最终实现煎蛋妹子图爬虫,所有爬虫框架本质上相似,Scrapy采用类似方式,绿地擒妖源码但使用Lifo Queue实现深度优先遍历。通过配置文件,可实现爬取目标数据,简化代码修改。遇到封锁时,可采用灵活策略应对,如使用pipeline。

Python适用于多个领域,如web开发、自动化运维、大数据分析、科学计算、机器学习和人工智能。从零基础到专业领域,Python均具有广泛应用。通过不同需求和专业背景,掌握Python可实现多种功能。

Python爬虫JS解密详解,学会直接破解%的网站!

Python爬虫遇到JS加密时,通过深入解析和解密,可以破解%的网站功能,下面以有道翻译为例,详细讲解这一过程。

首先,我们需要观察网页源代码,确认有道翻译的源码实现。虽然表面上看似完成,但实际翻译内容改变时,请求参数会变,这就需要找到这些动态参数的生成方法。

通过开发者工具,搜索关键词如"sign"和"translate_o",我们可以定位到加密操作的JavaScript代码。在调试模式下,观察salt、sign、lts、bv等参数的生成过程,会发现它们是通过特定函数计算得出的。

复制JavaScript加密代码到Python中,逐个实现相同的逻辑。例如,对于时间戳lts,需要调整Python生成的值以匹配JS格式。通过调整和转换,使Python生成的参数与JS保持一致。

在完成基本参数破解后,升级版的代码可以处理更复杂的需求,如对文章进行分段翻译,提升阅读理解能力,特别适合英语学习者使用。

虽然有道翻译可能会更新加密方式,但通过深入理解JS解密原理,我们仍能应对这些变化。以下是完整的Python实现代码和升级版效果的展示。

selenium进行xhs爬虫:获取网页源代码

学习XHS网页爬虫,本篇将分步骤指导如何获取网页源代码。本文旨在逐步完善XHS特定博主所有图文的抓取并保存至本地。具体代码如下所示:

利用Python中的requests库执行HTTP请求以获取网页内容,并设置特定headers以模拟浏览器行为。接下来,我将详细解析该代码:

这段代码的功能是通过发送HTTP请求获取网页的原始源代码,而非经过浏览器渲染后的内容。借助requests库发送请求,直接接收服务器返回的未渲染HTML源代码。

在深入理解代码的同时,我们需关注以下关键点:

Python爬虫腾讯视频m3u8格式分析爬取(附源码,高清无水印)

为了解析并爬取腾讯视频的m3u8格式内容,我们首先需要使用Python开发环境,并通过开发者工具定位到m3u8文件的地址。在开发者工具中搜索m3u8,通常会发现包含多个ts文件的链接,这些ts文件是视频的片段。

复制这些ts文件的URL,然后在新的浏览器页面打开URL链接,下载ts文件。一旦下载完成,打开文件,会发现它实际上是一个十几秒的视频片段。这意味着,m3u8格式的文件结构为我们提供了直接获取视频片段的途径。

要成功爬取,我们需要找到m3u8文件的URL来源。一旦确定了URL,由于通常涉及POST请求,我们需要获取并解析对应的表单参数。接下来,我们将开始编写Python代码。

首先,导入必要的Python库,如requests用于数据请求。接着,编写代码逻辑以请求目标URL并提取所需数据。遍历获取到的数据,将每个ts文件的URL保存或下载。最后,执行完整的爬虫代码,完成视频片段的爬取。

3.网络爬虫——Requests模块get请求与实战

网络爬虫入门:掌握Requests模块与GET请求实践

学习网络爬虫的第一步,是了解如何使用Python的requests库获取网页源代码。本文将带你从安装requests库开始,逐步掌握GET请求的使用方法,让你能够轻松爬取网站数据。

先来了解一下urllib模块,它是Python内置的HTTP请求库,包含四个主要模块,提供基础的HTTP功能。

接着,介绍requests模块的使用。首先,通过pip命令安装requests库,安装成功后,你就可以利用它发送HTTP请求了。

在实际操作中,我们通常需要使用GET请求来获取网页数据。当数据在网页链接中时,通过requests.get()函数发送GET请求,获取HTML内容。此外,请求头和状态码是了解请求过程的关键信息。请求头包含了HTTP请求的一些元信息,如请求方法、地址等,而状态码则帮助判断请求是否成功。

在爬取网站数据时,请求头扮演着重要的角色。它包括了用户代理、Cookie等信息,让服务器更好地理解请求,确保数据获取过程顺利进行。

通过代码示例,我们可以清晰地看到如何通过requests模块获取网页数据。比如,发送GET请求到特定URL,并解析响应状态码、请求头和HTML内容。这为后续的数据解析和处理打下了基础。

当数据获取成功后,我们可以通过编写代码将HTML内容保存到本地文件,便于后续分析和使用。在实际爬虫项目中,合理的文件存储策略至关重要,确保数据安全和易于访问。

最后,通过简单的案例演示了如何在网页中搜索和获取特定数据。尽管在本文中我们没有详细讲解数据解析技术,但在后续的章节中,你将学习到更深入的数据提取方法,实现精准的数据获取。

今天的学习就到这里,希望这些基础知识能为你的网络爬虫之旅铺平道路。如果你对网络爬虫感兴趣,期待你的持续关注。更多内容敬请期待下一期!