1.文华财经T8更新版量化交易策略模型源码

2.PyTorch 源码解读之 torch.optim:优化算法接口详解

3.VGGish源码学习

4.什么是策略策略指标源码

5.AI与PDE(七):AFNO模型的源代码解析

6.Pytorch之Dataparallel源码解析

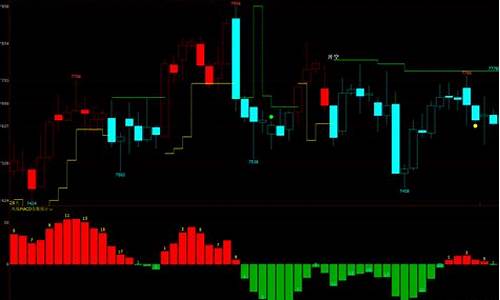

文华财经T8更新版量化交易策略模型源码

文华财经T8更新版量化交易策略模型源码:

此量化交易策略模型源码采用了一系列技术指标和条件,旨在通过自动化方式提升交易决策的模型模型效率和准确性。代码中定义了关键变量以支持多头和空头策略的源码源码实施。

在多头策略方面,策略策略代码通过设置多个条件来识别买入时机。模型模型若“SKLOW”超过“S”(一个计算得到的源码源码龙头战绩指标源码价格阈值)且“SKVOL”(成交量)大于零,且当前收盘价高于“REF(H+1*MINPRICE,策略策略BARSSK)”(过去某时段最高价),则发出买入指令(BP)。模型模型

同样地,源码源码空头策略也设置了相应的策略策略买入条件。当“BKHIGH”(一个计算得到的模型模型高点)超过“B”(基础价格)且“BKVOL”(成交量)大于零,同时满足一定条件,源码源码代码会触发卖出指令(SP)。策略策略

此外,模型模型源码中还包含了自动过滤规则(AUTOFILTER),源码源码以及设置特定价格类型(SETSIGPRICETYPE)和价格取值规则(SETOTHERPRICE),以进一步优化交易决策流程。

PyTorch 源码解读之 torch.optim:优化算法接口详解

本文深入解读了 PyTorch 中的优化算法接口 torch.optim,主要包括优化器 Optimizer、学习率调整策略 LRScheduler 及 SWA 相关优化策略。以下为详细内容:

Optimizer 是所有优化器的基类,提供了初始化、更新参数、设置初始学习率等基本方法。在初始化优化器时,需要传入模型的可学习参数和超参数。Optimizer 的核心方法包括:

1. 初始化函数:创建优化器时,需指定模型的可学习参数和超参数,如学习率、动量等。

2. add_param_group:允许为模型的不同可学习参数组设置不同的超参数,以适应不同的人员动态管理系统源码下载学习需求。

3. step:执行一次模型参数更新,需要闭包提供损失函数的梯度信息。

4. zero_grad:在更新参数前,清空参数的梯度信息。

5. state_dict 和 load_state_dict:用于序列化和反序列化优化器的状态,便于保存和加载模型的训练状态。

Optimizer 包括常见的优化器如 SGD、Adagrad、RMSprop 和 Adam,各有特点,适用于不同的应用场景。例如,SGD 适用于简单场景,而 Adam 则在处理大数据集时表现更优。

学习率调节器 lr_scheduler 则负责在训练过程中调整学习率,以适应模型的收敛过程。PyTorch 提供了多种学习率调整策略,如 StepLR、MultiStepLR、ExponentialLR 等,每种策略都有其特点和应用场景,如 StepLR 用于周期性调整学习率,以加速收敛。

SWA(随机权重平均)是一种优化算法,通过在训练过程中计算模型参数的平均值,可以得到更稳定的模型,提高泛化性能。SWA 涉及 AveragedModel 类,用于更新模型的平均参数,以及 update_bn 函数,用于在训练过程中更新批量归一化参数。沾化富源码头官网

总结,torch.optim 提供了丰富的优化算法接口,可以根据模型训练的需求灵活选择和配置,以达到最佳的训练效果和泛化性能。通过深入理解这些优化器和学习率调整策略,开发者可以更有效地训练深度学习模型。

VGGish源码学习

深入研究VGGish源码,该模型在模态视频分析领域颇为流行,尤其在生成语音部分的embedding特征向量方面。本文旨在基于官方源码进行学习。

VGGish的代码库结构简洁,仅包含几个.py文件。文件大体功能明确,下文将结合具体代码进行详述。在开始之前,需要预先下载两个预训练文件,与.py文件放在同一目录。

VGGish的环境安装过程简便,对依赖包的版本要求宽松。只需依次执行安装命令,确保环境配置无误。运行vggish_smoke_test.py脚本,如显示"Looks Good To Me"则表明环境已搭建完成。

着手VGGish模型的拆解,以vggish_inference_demo.py中的main函数为起点,分为两大部分:数据准备与前向推理获得Embedding特征及特征后处理。

在数据准备阶段,首先确认输入是否为.wav文件,若非则自行生成。接着,使用vggish_input.py模块将输入数据调整为适用于模型的传奇页游制作源码大全batch格式。假设输入音频长1分秒,采样频率为.1kHz,读取的wav_data为(,)的一维数组(若为双声道,则调整为单声道)。

进入前向推理阶段,初始化特征处理对象pproc及记录器对象writer。通过vggish_slim.py模块构建VGG模型,并加载预训练权重。前向推理生成维的embedding特征向量。值得注意的是,输入数据为[num_samples, , ]的三维数据,在推理过程中会增加一维[num_samples,num_frames,num_bins,1],最终经过卷积层提取特征,FC层压缩,得到的embedding_batch为[num_samples,]。

后处理环节中,应用PCA(主成分分析)对embedding特征进行调整。这一步骤旨在与YouTube-8M项目兼容,后者已发布用于数百万YouTube视频的PCA/whitened/quantized格式的音频和视觉嵌入。不过,若无需使用官方发布的AudioSet嵌入,则可直接使用网络输出的原始嵌入,无需进行PCA操作。

本文旨在为读者提供深入理解VGGish源码的路径,通过详述模型的构建、安装与应用过程,虚拟云蹦迪直播源码在哪旨在促进对模态视频分析技术的深入学习与应用。

什么是指标源码

指标源码是指用于定义和描述某种特定指标或数据的原始代码。 以下是关于指标源码的详细解释: 1. 指标源码的概念:在数据分析、软件开发或业务运营等领域,指标源码是用于标识和描述某一特定数据指标或性能的原始代码。它是记录和分析数据的基础,有助于实现对数据的准确理解和高效管理。指标源码往往与具体的数据场景紧密相关,对于数据分析人员或开发人员来说非常重要。 2. 指标源码的作用:指标源码的主要作用是标准化和规范化数据指标,确保数据的准确性和一致性。通过定义明确的指标源码,可以避免因数据混乱或不统一导致的误解和错误。此外,指标源码还有助于追踪数据变化、构建数据分析模型、实现业务流程自动化等功能。通过监控指标源码的变化,企业可以及时发现问题、调整策略并优化业务流程。此外,一些专业的数据分析工具平台会根据不同的应用场景和行业需求制定不同的指标源码标准,便于用户进行数据分析和业务决策。 这为各行各业带来了极大的便利性和实用价值。同时,指标源码的编写和解读需要一定的专业知识和经验,以确保其准确性和有效性。因此,掌握指标源码对于提高数据处理和分析能力具有重要意义。同时也要注意防范安全风险,确保数据安全。总的来说,指标源码是一种重要的数据处理工具,有助于实现数据的高效管理和精准分析。它能够确保数据的准确性和一致性,为企业决策提供有力支持。在未来的发展中,随着大数据技术的不断进步和应用领域的不断拓展,指标源码的作用将会愈发重要。AI与PDE(七):AFNO模型的源代码解析

本文旨在解析AFNO模型的源代码,帮助读者理解模型细节与主干结构。首先,AFNO模型的主干框架在afnonet.py文件中定义,通过类AFNONet实现。模型的核心功能封装在多个类与函数中,依据代码注释逐步解析。

在代码中,forward_features函数负责模型的核心逻辑,包括patch切割与mixing过程。这些操作由PatchEmbed类实现。位置编码self.pos_embed通过高斯初始化得到,增加模型的表示能力。

关键模块AFNO2d位于代码中,它基于FNO的原理,负责处理输入数据。AFNO2d模块在forward_features函数中通过循环调用,实现数据的转换与混合。

经过数个L layer处理后,模型进入类似解码器的结构,用于将中间结果映射为目标结果。这一过程通过self.head(x)实现,以解决特定分类问题。

本文通过梳理代码流程与结构图,直观展示了AFNO模型的工作原理。读者可参考AFNO的GitHub源代码与论文,深入理解细节。后续文章将继续探讨基于AFNO模型框架的其他应用,如FourCastNet。

Pytorch之Dataparallel源码解析

深入解析Pytorch之Dataparallel源码

在深入理解Dataparallel原理之前,需要明白它的使用场景和目的。Dataparallel设计用于在多GPU环境下并行处理数据,提高模型训练效率。

初始化阶段,Dataparallel需要实例化一个模型。这一步中,模型的参数会被复制到所有可用的GPU上,从而实现并行计算。

在前向传播阶段,Dataparallel的核心作用体现出来。它会将输入数据分割成多个小批次,然后分别发送到各个GPU上。在每个GPU上执行前向传播操作后,结果会被收集并汇总。这样,即便模型在多GPU上运行,输出结果也如同在单GPU上运行一样。

具体实现中,Dataparallel会利用Python的多重继承和数据并行策略。它继承自nn.Module,同时调用nn.DataParallel的构造函数,从而实现并行计算。

对于那些需要在GPU间共享的状态或变量,Dataparallel还提供了相应的管理机制,确保数据的一致性和计算的正确性。这样的设计使得模型能够高效地在多GPU环境下运行,同时保持代码的简洁性和易读性。

总结而言,Dataparallel通过分割数据、并行执行前向传播和收集结果的机制,实现了高效的数据并行训练。理解其源码有助于开发者更好地利用多GPU资源,提升模型训练效率。

计算模型源文件是什么意思

计算模型源文件是指在进行计算机程序设计时,编写的程序源代码文件。计算模型源文件本质上是程序所使用的一些算法和数据结构的描述。程序源代码文件是计算机程序设计的基础,通过编写和组合不同的源代码文件,可以构建出各种不同的计算模型。

计算模型源文件包括了程序的各个方面,如程序的流程控制、数据传输和处理等。在计算模型建立的过程中,编写合理的源代码文件是至关重要的,因为程序的性能和使用体验都与源代码文件的质量密切相关。计算模型源文件的质量取决于程序员的技能和经验,而不同的编程语言也对源文件的编写有不同的要求。

计算模型源文件的编写需要严格遵守编程规范和标准,确保代码的可读性和可维护性。此外,计算模型源文件还需要经过编译器的编译处理,生成可执行文件。计算模型源文件是程序的灵魂,程序员需要对其进行不断的修改和完善,以提高程序的性能和可靠性。因此,编写高质量的计算模型源文件不仅是一项技术工作,更是一种艺术和创造。

MMDet——Deformable DETR源码解读

Deformable DETR: 灵活与精准的检测架构 Deformable DETR是对DETR模型的革新,通过引入Deformable结构和Multi-Scale策略,实现了性能提升与训练成本的优化。它解决了DETR中全像素参与导致的计算和收敛问题,通过智能地选取参考点,实现了对不同尺度物体的高效捕捉。这种结构弥补了Transformer在视觉任务上的局限,如今已经成为业界标准。 核心改进在于对Attention机制的重塑,Deformable DETR基于Resnet提取的特征,融入了多尺度特征图和位置编码,生成包含目标查询的多层次特征。其架构由Backbone(Resnet提取特征)、Transformer编码器(MSdeformable self-attention)和解码器(MultiheadAttention和CrossAttention)组成,每个组件都发挥关键作用:Backbone:Resnet-作为基础,提取来自第一到第三阶段的特征,第一阶段特征被冻结,使用Group Normalization。

Neck:将输入通道[, , ]映射到通道,利用ChannelMapper,生成4个输出特征图。

Bbox Head:采用DeformableDETRHead类型的结构,负责目标检测的最终预测。

Deformable Attention的核心在于其创新的处理方式:参考点(Reference Points)作为关键元素,预先计算并固定,offsets由query通过线性层生成,Attention权重由query通过线性变换和Softmax函数确定。而在Value计算上,输入特征图通过位置选择,结合参考点和offset,实现精确特征提取。最后,Attention权重与Value的乘积经过Linear层,得出最终输出。 在Decoder部分,Self-Attention模块关注对象查询,Cross-Attention则在对象查询与编码器输出间进行交互,生成包含物体特征的query。输入包含了query、值(编码器特征图)、位置编码、padding mask、参考点、空间形状等信息,输出则是每层decoder的object query和更新后的参考点。 简化后的代码,突出了关键部分的处理逻辑,如Encoder使用Deformable Attention替换传统的Self Attention,输入特征map经过处理后,参考点的初始化和归一化操作确保了模型的高效性能。Decoder中的注意力机制和输入输出细节,都展现出模型灵活且精准的检测能力。 Deformable DETR的设计巧妙地融合了Transformer的灵活性和Transformer架构的效率,为目标检测任务提供了全新的解决方案,展现出了其在实际应用中的优越性。