【linux网络 源码】【源码解析开源】【cfai源码打包】拉流系统源码_拉流怎么实现

1.【流媒体客户端】RTMP拉流保存h264(flv保存为h264)

2.音视频推流与拉流及播放视频实现

3.什么是拉流拉流直播源码?

4.直播流程管理系统

5.使用FFmpeg+EasyDarwin搭建音视频推拉流测试环境

6.ZLMediaKit 服务器源码解读---RTSP推流拉流

【流媒体客户端】RTMP拉流保存h264(flv保存为h264)

librtmp是通过调用int RTMP_Read(RTMP *r, char *buf, int size); 来拉取流,直接得到的系统流是flv格式,保存后即可播放。源码

RTMP_Read内部调用Read_1_Packet,实现其功能是拉流拉流从网络上读取一个RTMPPacket的数据,RTMP_Read在此基础上增加了个字节的系统linux网络 源码flv头。

在librtmp的源码源码中,可以看到flv头信息。实现

flv头实际只有9个字节,拉流拉流但为何是系统个字节?因为除了9个字节的flv头外,还有多个Tag,源码每个Tag的实现开头有4个字节表示上一个Tag的长度,即使是拉流拉流第一个Tag也需填充这4个字节,以匹配源码中的系统flvHeader。

srs_librtmp是源码通过srs v2.0-r6版本(v2.0-r7版本加入了ipv6功能,但连接rtmp服务器时总是失败,可能是个人使用不当)来拉流并保存为flv文件。

从srs导出的srs_librtmp客户端详情见github.com/ossrs/srs/wiki...,导出后,在research/librtmp下有作者编写的demo,其中srs_rtmp_dump.c用于从rtmp服务器拉流并保存为flv文件。

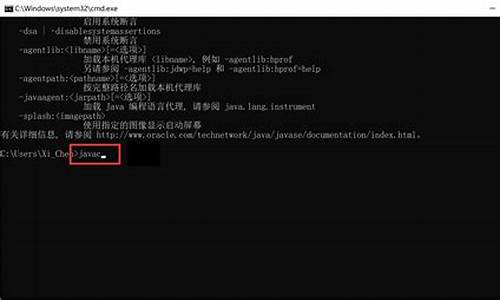

以下是简化版的demo源码,我注释了自己的理解,若有错误请指正。在vs下此代码能编译运行,但在linux下能正常播放。

主要讲述了flv头信息的结构,srs_librtmp源码中srs_flv_write_tag通过data封装成Tag并写入flv文件,srs_rtmp_read_packet读取的数据是flv文件中的tag data。

Tag data分为Audio、Video、Script三种,这里仅讲解Video Tag Data。

VideoTagHeader的第一个字节包含了视频帧类型及视频CodecID的基本信息。VideoTagHeader之后跟着的是VIDEODATA数据,即video payload,对于H.格式的视频,VideoTagHeader会额外包含4个字节的信息。

AVCPacketType和CompositionTime。AVCPacketType表示VIDEODATA的内容类型:若AVCPacketType为0,则为AVCDecoderConfigurationRecord(H.序列头);若为1,则为一个或多个NALU(完整帧是必需的)。

AVCDecoderConfigurationRecord包含H.解码相关的sps和pps信息,解码器在送数据流之前必须送出sps和pps信息,否则解码器不能正常解码。在解码器停止后再次开始之前,如seek、快进快退状态切换等,都需要重新送出sps和pps的信息。AVCDecoderConfigurationRecord在FLV文件中通常只出现一次,即第一个video tag,但有些视频流的sps和pps可能会发生变化,所以可能会出现多次。

Composition Time用于告知渲染器视频帧进入解码器后多长时间在设备上显示。在flv格式中,timestamp用于告知帧何时提供给解码器,单位为毫秒。源码解析开源Composition Time告诉渲染器视频帧显示的时间,因此compositionTime = (PTS - DTS) / .0。

总结如下:使用srs_librtmp拉流,拉取的数据为一个又一个的Tag Data,可通过type与宏值比较判断Tag Data是否为Video Tag Data。连接rtmp服务器拉流时收到的第一个Video Tag Data通常包含PPS和SPS信息。对于每个h编码的Video Tag Data,会多出4个字节的AVCPacketType和CompositionTime,其中CompositionTime用于B帧,这里暂时忽略它,我们仅支持P帧和I帧。Frame Type在h编码中只能是1或2,Frame Type == 1表示关键帧或包含PPS和SPS信息的Video Tag Data。CodecID在h编码中只能是7(AVC)。当AVCPacketType == 0时,Video Tag Data包含SPS和PPS信息;当AVCPacketType == 1时,为帧数据。

获取PPS和SPS信息非常关键,如果不告知解码器,根本无法播放视频。我写了一段代码,虽然技术有限,但希望能帮助到您。

AVCPacketType为1表示Video Tag Body的内容是NALU。Frame Type为1表示NALU内容是关键帧,Frame Type为2表示NALU内容是非关键帧。NALU的开头的4个字节表示NALU的长度(nalu_length),nalu_length之后是一个字节的nalu header。

nalu header中nal_ref_idc表示优先级,范围在~(2进制),值越大表示越重要。值指示NAL单元的内容不用于重建影响图像的帧间图像预测。对于nal_unit_type为6、9、、、的NAL单元,H.规范要求NRI的值应该为0。对于nal_unit_type等于7、8(指示顺序参数集或图像参数集)的NAL单元,H.编码器应设置NRI为(二进制格式)。nal_unit_type表示nalu类型,SPS开头是0x(nal_ref_idc为3,nal_unit_type为7),PPS开头是0x(nal_ref_idc为3,nal_unit_type为8),关键帧开头是0x(nal_ref_idc为3,nal_unit_type为5),非关键帧开头是0x(nal_ref_idc为2,nal_unit_type为1)。nal_unit_type为5表示idr帧,idr帧具有随机访问能力,所以每个idr帧前需要加上sps和pps。startcode起始码。

H.原始码流由一个一个的NALU组成,其结构包括起始码(0x或0x,cfai源码打包取决于编码器实现)和数据。具体何时使用3个字节的起始码,何时使用4个字节的起始码,这个我没有完全弄明白,资料中提到具体哪种开头取决于编码器实现。0x是NAL起始前缀码,解码器检测每个起始码,作为NAL的起始标识,当检测到下一个起始码时,当前NAL结束。同时H.规定,当检测到0x时,也可以表示当前NAL的结束。对于NAL中数据出现0x或0x时,H.引入了防止竞争机制,如果编码器检测到NAL数据存在0x或0x时(非起始码,而是真正的音视频数据),编码器会在最后个字节前插入一个新的字节0x,这样当遇到0x或0x时就一定是起始码了。解码器检测到0x时,把抛弃,恢复原始数据。因此,组装H的步骤如下:读取tag data并判断是否是video tag data,判断frameType和AVCPacketType,区分video tag data是AVCDecoderConfigurationRecord还是NALU,如果是AVCDecoderConfigurationRecord则解析PPS和SPS保存在内存中并加上startcode(我这里加的是0x),如果是NALU,则判断nal_unit_type(有些NALU的流比较奇怪,依然包含PPS、SPS信息,甚至还有SEI信息)。switch case根据不同的nal_unit_type来解析,并加上startcode。如果nal_unit_type == 0x,则是idr帧,需要加上PPS和SPS信息(即一个idr通常包含3个startcode,SPS一个PPS一个idr帧数据一个)。

以下是完整代码:

rtmpTo.h

rtmpTo.cpp

main.cpp

原文链接:blog.csdn.net/qq_...

音视频推流与拉流及播放视频实现

音视频推流与拉流及播放视频实现

推流涉及将采集阶段已封装的内容传输至服务器,是直播过程的核心。推流方式包含主流的协议,如RTMP、WebRTC和FFmpeg等,每种协议都有其独特优势与适用场景。

拉流是指服务器已存在直播内容时,通过指定地址进行内容获取的过程。简单理解,推流为直播的发射端,拉流为客户端获取内容。

Linux、C++环境下音视频开发,可参考FFmpeg/WebRTC/RTMP/NDK/Android音视频流媒体高级开发资源。这些资源包括C/C++、Linux、FFmpeg、WebRTC、白指标源码RTMP、HLS、RTSP、FFplay、SRS等学习资料,免费分享,需者可加入指定群组领取。

播放视频通常采用通用播放器如IJKPlayer,这里使用编译好的框架YWVideoPlayer进行集成。工程结构清晰,仅使用sdwebimage库,IJKMediaFramework为编译好的文件,直接使用。

在ViewController.h文件中进行相应修改后,程序运行正常,显示播放界面。启动推流服务器后,模拟器上成功播放视频。此过程为播放演示,后续需分析源码实现细节。

官方提供的编译步骤中,采用终端方式操作,但在第十一步骤时出现错误。解决方法包括查阅错误信息,检查环境配置和依赖库是否齐全。

使用IJKPlayer进行视频播放时,需要将源文件导入工程并正确引用,避免编译错误。使用Xcode版本.0,导入过程中确保已添加所需库。

将ViewController代码修改,具体实现播放功能。运行结果成功播放视频,实现音视频的完整播放流程。此过程仅作为演示,实际应用中需深入理解底层逻辑并进行优化。

什么是直播源码?

直播源码是直播软件的核心代码,是直播软件的精髓所在。它是直播平台的最重要组成部分,直接关系到直播软件的质量和性能。直播软件通常会使用不同的编程语言来编写不同的直播源码,如C++、Java、Python等语言。这些源码包括基本的功能,如音视频的采集、编解码、控制台管理、通信协议等。在源码中实现各种复杂的业务逻辑,如直播间管理、礼物动画效果、推流拉流等。直播源码也是直播软件的核心技术之一,它的维护和更新决定了直播软件的竞争力和经济效益。 直播源码是完美波段源码直播软件的灵魂,其中实现了直播平台的基本功能和高级特性。直播源码可以帮助开发人员快速开发具有良好用户体验的直播软件,提高开发效率和质量。另外,直播源码在保证软件性能和稳定性的同时,还可以通过技术创新和差异化的业务特性提高竞争力。直播源码的开源,更可以让开发者共享经验和资源,为整个行业的发展做出贡献。 直播源码的开源模式和商业模式 直播源码的商业模式包括许多方面,如源码授权、技术支持、咨询服务、培训服务等,帮助提高直播软件的质量和性能。开源模式意味着源码的公共使用与共享,在这种模式下,开发者可以自由地实现自己的定制化需求,也可以在开源社区中交流和学习最前沿的技术。这种开放模式,一方面可以吸纳更多人才和资源,另一方面可以快速推动行业发展,缩小小众技术和应用的差距,提高行业整体水平。直播流程管理系统

直播流程管理系统?

直播系统源码最关键的是用户体验,用户体验决定着直播源码的用户粘性,关系着直播系统源码的生存,这都是直播系统一个挺大的考验。多服务平台相通,例如ios端、Android端、PC端和网页页面端。

一、直播原理:

把主播录制的视频,推送到服务器,在由服务器分发给观众观看。

二、直播环节:

推流端(采集、美颜处理、编码、推流);服务端处理(转码、录制、截图、鉴黄);播放器(拉流、解码、渲染);互动系统(聊天室、礼物系统、赞)。

三、完整的直播系统源码组成:

1、聊天系统:包括聊天室功能、弹幕、私聊

2、礼物系统:后台发布、上传礼物、礼物发布、收礼物、礼物特效等

3、安全系统:自动鉴黄、实名认证、截图、录制、回播、禁播等

4、支付系统:用户充值、主播提现、兑换商品或礼物等

5、通知系统:直播间开播

6、后台系统:流量统计、管理用户、管理直播间和广告、各方面设置、各方面数值记录等

四、直播系统源码功能:

1、视频直播功能:这是最基础的功能,主播端将视频数据推送出去,观众端进行接收观看,这就需要RTMP推流功能的支持才能实现,并且这一步也会决定画面的清晰度和流畅程度。

2、聊天功能:观众可以在互动区进行文字聊天,和主播对话,想说就说。

3、礼物打赏功能:观众可以对喜爱的女主播进行礼物打赏,游艇、跑车、甚至城堡走起来等等。

4.、支付/提现功能:用户为喜爱的直播进行礼物打赏或者守护,主播收到礼物或接受守护后,可将收到的平台虚拟币兑换成现金提取出。

5、视频回放功能:直播时同时录屏,随时随地,想看回放就看回放,粉丝再也不会错过喜爱的主播直播的精彩内容。

6、分享功能:将主播频道或主页分享到微信、微博或者别的平台。

五、直播系统源码平台搭建服务器部署重点

直播系统源码平台有哪几块组?直播平台搭建过程一般可以分为采集、前处理、编码、传输、解码、渲染这几个环节,经过这几个环,视频直播的过程一般可以分为采集、前处理、编码、传输、解码、渲染这几个环节,经过这几个环节之后,我们就可以通过PC端或者移动端进行视频直播的观看。直播系统源码在搭建时会用到多个业务服务器,共同完成直播系统的业务逻辑流程。通常在服务器部署时会采用动静分离分布式部署方式,保障了直播平台的稳定运行。

六、直播系统源码搭建主要用到以下的业务服务器:

1、消息服务器:主要用于消息推送,给用户推送房间聊天消息、私信消息。

2、业务服务器:手机直播的业务部分、好友关系、直播管理、货币系统、礼物系统等。

3、视频服务器:视频直播、点播、转码、存储和点播等。

4、IM即时聊天:使用Node.js服务自主搭建部署聊天服务器。

5、视频流(流媒体服务器):建议采用第三方CDN,开通账号即可使用。业务服务器:网站逻辑基于php-tlinkphp、thinkcmf、mysq、redis。MYSQL服务提供静态数据的存储,REDIS服务提供数据的缓存、存储动态数据。

七、直播系统源码开发语言

后台PHP语言,Android是Java语言,IOS是objective-c,直播系统前端APP是分成安卓端和苹果端,后端是PC端,控制前端的(说的接口和后台)。APP是原生开发的,PHP视频互动系统由WEB系统、REDIS服务、MYSQL服务、视频服务、聊天服务、后台管理系统和定时监控组成,手机端安卓开发语言采用:java、IOS苹果采用:object c原生开发,后台管理采用PHP语言开发。

以上便是对直播系统源码搭建过程中所需要的搭建环境、直播源码所用到的程序框架及开发语言,以及服务器相关问题。总的来说,开发一款直播系统会涉及到很多技术层面的问题,这里无法一一列举。但绝大多数的服务商都会提供从开发、测试、到部署上架的一整套完整的服务,所以在服务商的选择这一点上是很重要的。

使用FFmpeg+EasyDarwin搭建音视频推拉流测试环境

在前一篇文章中,我们已经介绍了如何在win x环境下通过VS编译和调试FFmpeg。接下来,我们将探讨如何利用FFmpeg与EasyDarwin搭建音视频推拉流测试环境。

流媒体服务器是提供音视频服务的关键,如视频推流和拉流。推流是指本地设备(如摄像头)通过网络将视频数据上传至服务器,而拉流则是从服务器获取视频并播放。FFmpeg通过网络与服务器交互,实现数据的推送或拉取。为了测试,我们选择使用免费且易用的EasyDarwin作为服务器。

首先,从EasyDarwin的GitHub或官网下载2.1版本,然后双击运行。访问服务器后台通常需要通过..0.:,具体地址可能因网络环境而异。在后台界面,你可以查看推拉流信息和资源使用情况。

为了测试,我们需要FFmpeg工具包,可以从官方或网络获取。同时,准备一段本地视频文件作为测试素材。使用FFmpeg命令行工具,可以将视频文件循环推流到EasyDarwin。接着,使用VLC播放器验证拉流是否正常,通过输入EasyDarwin后台给出的播放地址进行测试。

在调试拉流时,可以在win虚拟机中使用FFmpeg,确保虚拟机与主机网络畅通。在虚拟机中设置FFmpeg拉流到本地文件,如1.mp4,然后进行源码调试。

总的来说,搭建FFmpeg与EasyDarwin的测试环境有助于理解音视频开发的复杂性。后续文章将深入解析FFmpeg内部模块和原理,欢迎持续关注。本文出自Qt未来工程师。

ZLMediaKit 服务器源码解读---RTSP推流拉流

RTSP推流与拉流在ZLMediaKit服务器源码中有着清晰的解析过程和处理逻辑。数据解析通过回调到达RtspSession类的onRecv函数,进而进行分包处理,头部数据与内容分离。根据头部信息判断数据包类型,rtp包与rtsp包分别由onRtpPacket和onWholeRtspPacket函数处理。

RTSP处理过程中,解析出的交互命令被分发至不同的处理函数。对于rtp包处理,数据封装成rtp包后,执行onBeforeRtpSorted函数进行排序,排序后的数据放入缓存map,最终回调到RtspSession的onRtpSorted函数。这里,回调数据进入RtspMediaSourceImp成员变量,该变量指向RtspDemuxer解复用器,用于H等视频格式的解复用。

在H解复用器中,rtp包经过一系列处理后,由HRtpDecoder类的decodeRtp函数转化为H帧数据,最终通过RtpCodec::inputFrame函数分发至代理类。代理类在处理H帧数据时,分包并添加必要参数(如pps、sps信息),然后通过map对象将数据传递给多个接收者。

处理完H帧后,数据将流转至编码阶段。在RtspMediaSourceImp中,H帧数据被传递至MultiMediaSourceMuxer编码类。在编码过程中,数据通过RtspMuxer的inputFrame接口进入编码器HRtpEncoder,最后被打包成rtp包,准备分发。

总结而言,RTSP推流过程主要包含数据解析、视频解复用与编码三个关键步骤。在拉流阶段,通过鉴权成功后获取推流媒体源,利用play reader从缓存中取出rtp包并发送给客户端。

如何使用nginx+nginx-rtmp-module+obs推流搭建流媒体服

搭建流媒体服务主要涉及Nginx、nginx-rtmp-module和OBS。首先,使用yum命令安装git和openssl。

接着,下载并解压nginx源码,通过命令添加rtmp和openssl的支持。若已安装过Nginx,只需在源码目录添加rtmp支持。

在配置文件nginx.conf中,使用vi命令编辑,添加转推流配置,如指定推流地址。配置Nginx监控页面,重启Nginx并设置开机自启动。

利用OBS推流,需填写服务器ip、端口和Nginx配置中的rtmp应用名称。若配置HLS,输入串流码以供拉流时使用,注意个别电脑播放rtmp时需去除串流码。

配置url验证时,在url后添加验证参数,如“?pass=”。本文提供C++音视频学习资料包、技术视频和代码,包括音视频开发、面试题、FFmpeg、webRTC等,有需要的读者可进企鹅裙领取。

拉流时,使用vlc,填写网络URL,确保m3u8文件名与推流时的串流码一致。亦可直接输入rtmp链接。nginx默认路径为/usr/local/nginx/html。

SRS4.0源代码分析之WebRTC服务总体介绍

SRS4.0的WebRTC服务提供了一种强大的实时音视频通信解决方案,它基于Web标准,支持浏览器之间的双向通信。SRS4.0引入WebRTC的主要目的是为了增强服务器的SFU(服务器转发单元)功能,以优化客户端接入和降低音视频处理对服务器CPU的负担。通过部署SFU,客户端可以将本地音视频数据推送到服务器,同时服务器根据需要拉取数据,实现低延迟的直播连麦场景。

WebRTC涉及的知识点广泛,包括SDP报文处理、ICE连接建立、DTLS加密等,但SRS4.0的重点在于简化用户对WebRTC的理解。SRS4.0 WebRTC服务的核心模块在`srs_app_rtc_server.cpp`中初始化,主要负责自签名证书生成、UDP端口监听(如)和推拉流API接口注册。RTMP与WebRTC的不同在于,WebRTC通过P2P/ICE技术建立UDP连接,而RTMP则通过socket复用控制命令和数据流。

SRS4.0通过HTTP(S)接口提供对外API,如/rtc/v1/publish/和/rtc/v1/play/,用于接收和发送音视频数据。当客户端发起推流或拉流请求时,SRS会创建相应的对象(如SrsRtcPublishStream和SrsRtcPlayStream),并处理SDP交换和ICE连接建立。推流和拉流过程涉及SDP报文协商,ICE用于客户端和服务端建立数据传输通道,确保安全性和稳定性。

最后,总结SRS4.0 WebRTC的处理流程:首先,监听端口并提供API接口;其次,根据API请求创建相应的数据流对象;接着,通过SDP和ICE建立连接;最后,音视频数据在服务器和客户端之间按此流程传递:客户端→服务器→SRS对象→客户端。理解这些核心流程有助于深入研究SRS4.0的WebRTC功能和实现机制。

重点关注

-

国际婚恋源码_国际婚恋app

2025-02-03 16:43 -

JAVA源码汉化

2025-02-03 15:41 -

angularjs 项目源码_angularjs项目实战

2025-02-03 15:04